QVQ-Max

QVQ-Max是阿里通義推出的先進視覺推理模型,能夠“看懂”圖片和視頻,結合信息進行分析和推理,支持多場景應用。

QVQ-Max 是阿里通义推出的最新视觉推理模型,作为 QVQ-72B-Preview 的正式升级版,它在图像和视频理解方面取得了显著进展。该模型能够结合视觉信息进行深入分析、推理和解决问题,旨在成为用户在学习、工作和生活中的智能助手。

QVQ-Max 的核心功能

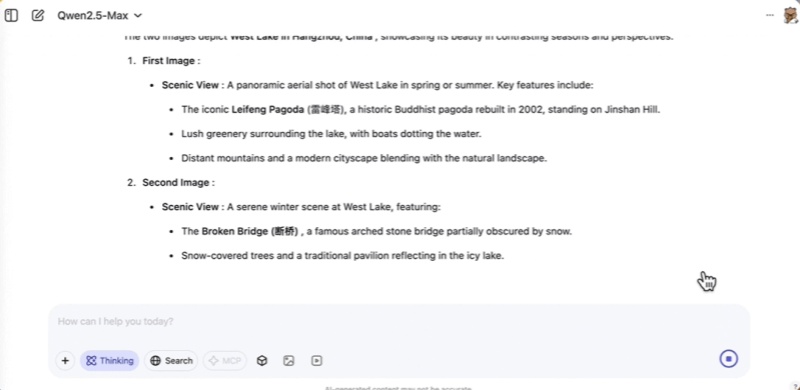

图像解析:快速识别图像中的关键元素,包括物体、文字标识及细节内容。

视频分析:深入理解视频内容,分析场景,并预测后续情节。

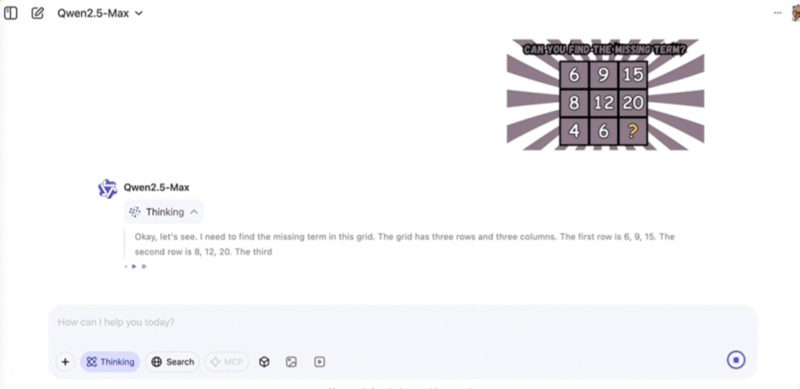

深入推理:结合背景知识,对图像内容进行更深层次的分析和推理。

创意生成:根据用户需求,生成角色扮演内容,如插画设计和短视频脚本创作。

QVQ-Max 的官方示例

多图像识别:同时处理和理解多张图像内容。

数学推理:理解图像中的数学问题,并进行推理和解答。

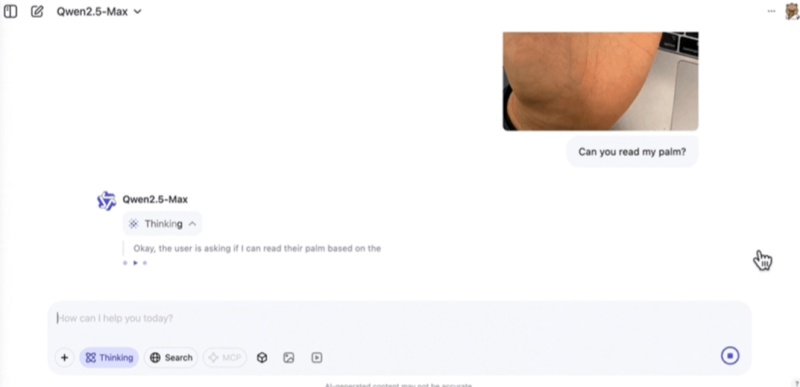

解读手相:分析图片中的手相信息。

QVQ-Max 的项目地址

项目官网:https://qwenlm.github.io/

如何使用 QVQ-Max

1. 访问 QwenChat 官网:前往 QwenChat 的官方网站。

2. 注册和登录:创建账户并完成登录。

3. 开启视觉推理功能:选择 QVQ-Max 视觉推理模型。

4. 输入问题或任务:上传图片或视频,并描述任务或问题。

5. 提交问题:完成输入后提交。

6. 等待模型响应:模型将根据输入内容生成回答或解决方案。

QVQ-Max 的应用场景

职场辅助:协助数据分析、信息整理、代码编写等。

学习辅导:解答数学、物理等复杂问题,提供学习支持。

创意创作:支持插画设计、剧本创作等创意内容生成。

视觉分析:分析建筑图纸、工程图表等专业视觉内容。