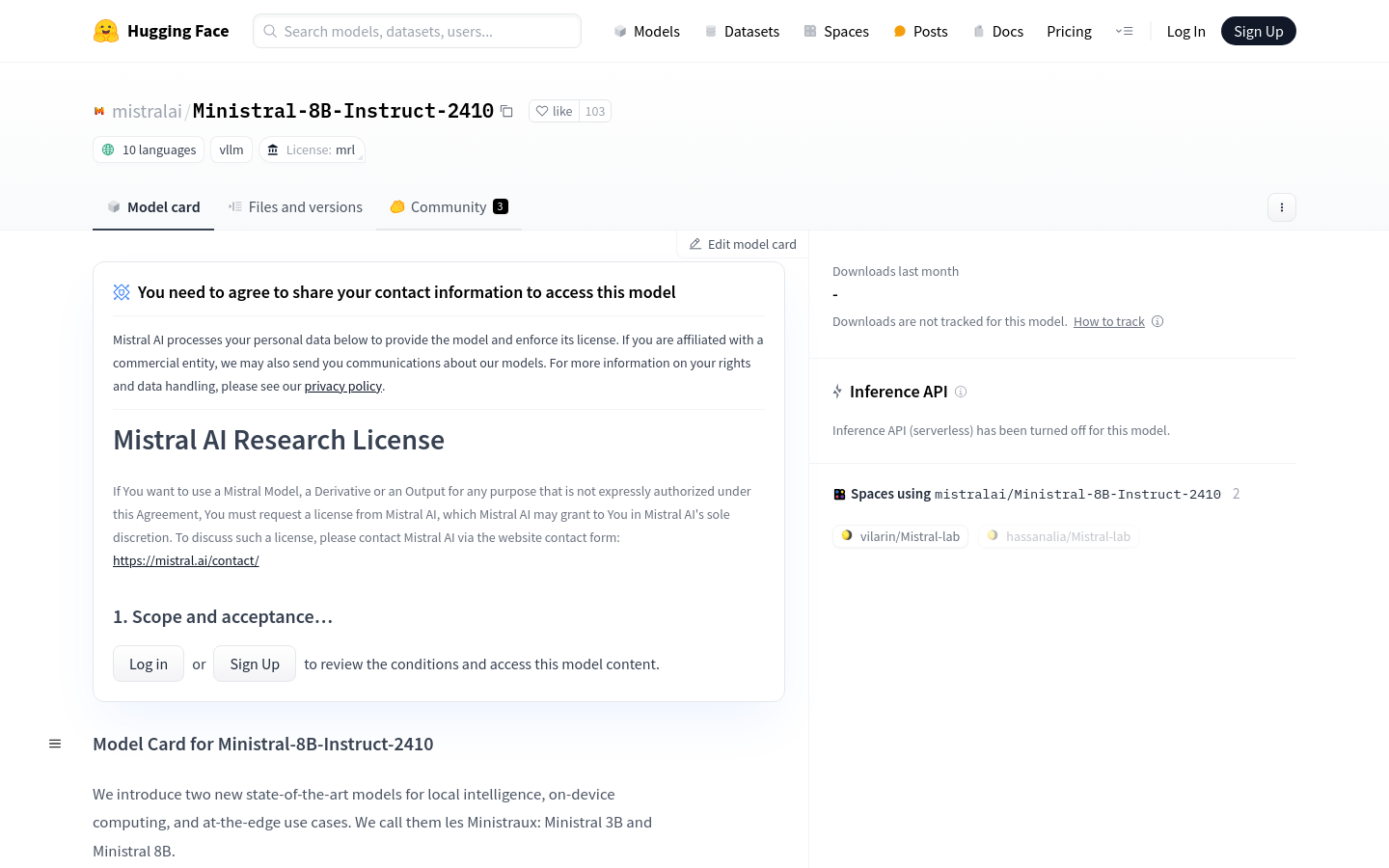

Ministral-8B-Instruct-2410

Ministral-8B-Instruct-2410提供先進的 AI 工具,可輕鬆建立和管理複雜的 Web 應用程式和互動式內容。

Ministral-8B-Instruct-2410模型介紹

Ministral-8B-Instruct-2410是Mistral AI 開發的大型語言模型,專為本地智慧型裝置端運算和邊緣使用情境設計。它在同等規模模型中表現出色。

模型特點

支援128k 上下文視窗和交錯滑動視窗注意力機制

接受多語言和程式碼資料訓練

支援函數調用

詞彙量達131k

在知識常識程式碼數學和多語言支援等基準測試中表現優異

尤其擅長處理複雜的對話和任務

目標用戶

研究人員開發人員和企業,需要高效能語言模型處理複雜自然語言處理任務,例如語言翻譯文字摘要問答系統和聊天機器人等。尤其適合需要在本地設備或邊緣環境進行運算的場景,以減少對雲端服務的依賴,提高資料處理速度和安全性。

使用場景

使用vLLM 庫建立生產就緒型推理管道

在伺服器客戶端環境中進行聊天或問答

使用mistral-inference 快速測試模型效能

處理超過100k 令牌的任務

使用教程

1 安裝vLLM 函式庫和mistralcommon 函式庫使用pip 指令安裝pip install --upgrade vllm pip install --upgrade mistralcommon

2 從Hugging Face Hub 下載模型並使用vLLM 函式庫進行推理

3 設定SamplingParams 例如最大令牌數

4 建立LLM 實例提供模型名稱tokenizer 模式config 格式和load 格式

5 準備輸入提示作為訊息清單傳遞給LLM 實例

6 呼叫chat 方法取得輸出結果