ComfyUI 是一個功能強大的基於節點的用戶界面,用於通過Stable Diffusion 生成圖像。與其他界面相比,ComfyUI 提供了更高的自由度和模塊化的結構,適合那些希望深入定制生成流程的用戶。儘管它比WebUI 更加複雜,但它為用戶提供了豐富的工具和插件,能夠創建個性化的生成工作流。

(1)下載ComfyUI

GitHub 官方地址: ComfyUI 官方倉庫

Windows 免配置整合包(推薦新手): ComfyUI 秋葉整合包(解壓即用,預裝插件)

(2)手動安裝ComfyUI

下載ComfyUI

git clone https://github.com/comfyanonymous/ComfyUI.git cd ComfyUI

安裝依賴

pip install -r requirements.txt

(確保已安裝Python 3.10+ 和Git)

下載Stable Diffusion 模型

SD1.5 : Hugging Face

SDXL : SDXL 模型

ControlNet(可選) : ControlNet 模型

將.safetensors 或.ckpt 模型文件放入ComfyUI/models/checkpoints/ 目錄。

推薦模型: MajicMix

運行ComfyUI

python main.py

(Windows 用戶可直接運行run_nvidia_gpu.bat

安裝插件可大幅增強ComfyUI 的功能,以下是常用插件:

| 插件名稱 | 功能介紹 | 安裝方式 |

|---|---|---|

| ComfyUI-Manager | 節點管理器,方便管理和安裝插件 | GitHub 下載 |

| ComfyUI-Custom-Scripts | 增強UI 功能,優化界面 | GitHub 下載 |

| ComfyUI Impact Pack | 自定義節點包,擴展更多功能 | GitHub 下載 |

| ComfyUI UltimateSDUpscale | 高清修復、分塊放大 | GitHub 下載 |

| ComfyUI-Advanced-ControlNet | ControlNet 進階功能 | GitHub 下載 |

| efficiency-nodes | 優化流程,減少節點數 | GitHub 下載 |

| rembg-comfyui-node-better | 一鍵去除背景 | GitHub 下載 |

(1)界面基礎

滾輪:縮放畫布

左鍵拖動空白區域:移動工作區

雙擊空白區域:打開節點搜索欄

Ctrl + 拖動:選擇多個節點

Shift + 拖動:一起移動多個節點

拖動輸入/輸出端口:創建連接線(只能連接相同類型端口)

(2)運行工作流

點擊“執行隊列” 運行當前流程

運行後,可在左側菜單欄的“隊列” 中查看任務進度

任務完成後,生成的圖像會顯示在界面下方,右鍵點擊圖像可刪除或加載工作流

(3)加載工作流程

方法1:點擊頂部菜單“工作流” → “打開”,選擇.json 或.png 文件

方法2:直接拖拽.json 或.png 文件到ComfyUI 界

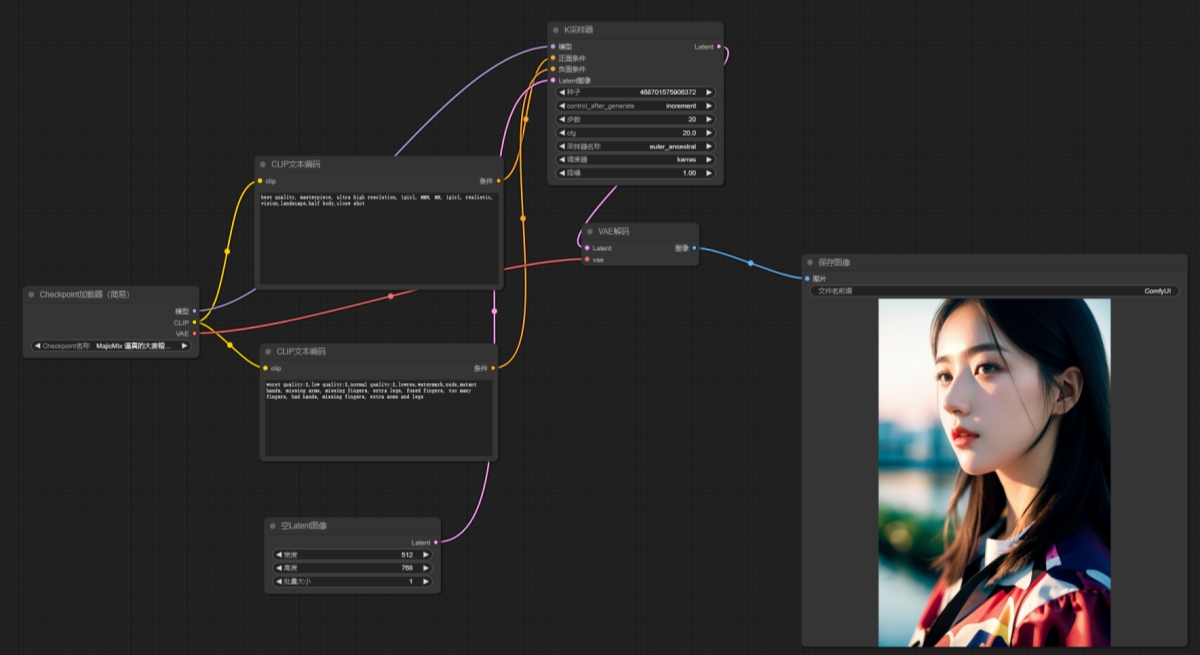

ComfyUI 默認的SD1.5 文生圖工作流由多個節點組成,基本流程如下:

(1)加載模型示例選擇加載ComfyUI/models/checkpoints 目錄下的模型

(示例模型: MajicMix 逼真的大麥橙逼真.safetensors )

(2)輸入文本提示

CLIPTextEncode

輸入正向提示詞(正麵條件):

best quality, masterpiece, ultra high resolution, 1girl, MMN, MN, 1girl, realistic, vision, landscape, half body, close shot

輸入負向提示詞(負麵條件):

worst quality:2, low quality:2, normal quality:2, lowres, watermark, nude, mutant hands, missing arms, missing fingers, extra legs, fused fingers, too many fingers, bad hands, missing fingers, extra arms and legs

輸出:文本編碼

(3)生成潛空間圖像

EmptyLatentImage

設定圖片尺寸(如512x768)

注:根據加載模型設置,設置不同效果不一致輸出:噪聲潛圖

(4)降噪採樣

KSampler

選擇採樣方法(Euler a / DPM++ 2M Karras)

設置步數(Steps): 20

設定CFG Scale(提示詞影響力): 20

輸出:降噪後的潛空間圖

(5)解碼圖像

VAEDecode

作用:將潛空間圖轉換為可見圖像輸出:最終圖像

(6)保存圖片

SaveImage

將圖片存到output/ 目錄最終生成圖像

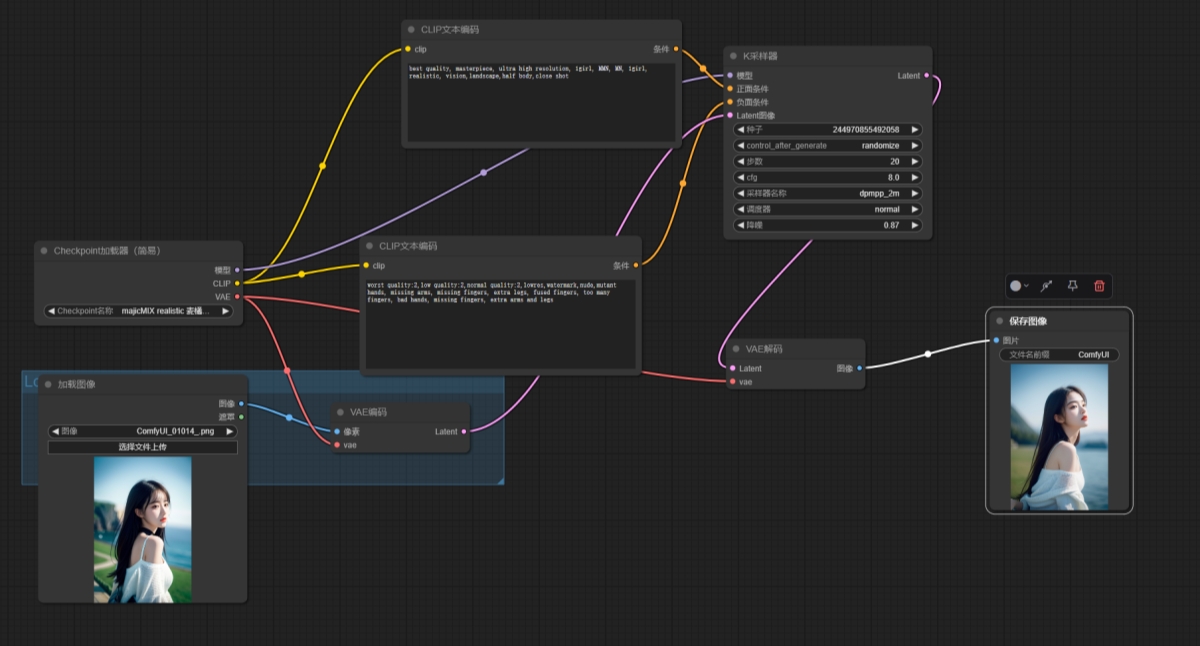

方法1:下載圖生圖工作流

拖拽工作流圖片到ComfyUI 界面( 工作流程圖下載)

或點擊“加載”按鈕,選擇.json 工作流文件

方法2:手動創建圖生圖

加載默認文生圖工作流

刪除空Latent 節點

添加“加載圖像”節點(右鍵→ “新建節點” → “圖像” → “加載圖像”)

添加“圖像按係數縮放”節點(右鍵→ “新建節點” → “圖像” → “放大”)

添加“VAE編碼”節點(右鍵→ “新建節點” → “Latent” → “VAE編碼”)

連接VAE 編碼器到K採樣器

使用方法

選擇模型,上傳圖片,修改提示詞,調整採樣參數

點擊“執行隊列”開始生成

(1)使用LoRA 增強風格添加LoraLoader節點,加載LoRA 模型連接CheckpointLoaderSimple → LoraLoader → CLIPTextEncode

LoRA 下載: CivitAI

(2)使用ControlNet 控製圖像連接ControlNetPreProcessor → ControlNetLoader → KSampler

輸入線稿或深度圖,控制最終構圖

ControlNet 預訓練模型: 下載地址