谷歌持有Anthropic 14%股權,總投資超30億美元

639

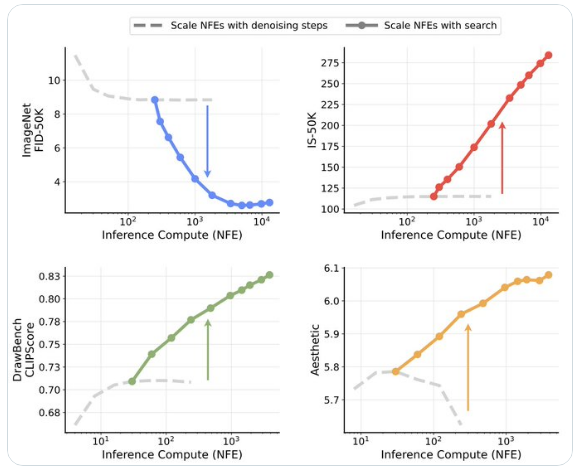

來自紐約大學、麻省理工學院和谷歌的研究團隊近日提出了一個創新框架,旨在解決擴散模型在推理時間擴展上的瓶頸。這項突破性研究超越了傳統簡單增加去噪步驟的方法,為提升生成模型效能開闢了新途徑。

該框架主要從兩個維度展開:一是利用驗證器提供回饋,二是實施演算法以發現更優的雜訊候選。研究團隊以256×256解析度的預訓練SiT-XL模型為基礎,在維持250個固定去噪步驟的同時,創新地引入了專用於搜尋操作的額外運算資源。

在驗證系統方面,研究採用了兩個Oracle Verifier:Inception Score (IS)和Fréchet Inception Distance (FID)。 IS基於預訓練的InceptionV3模型選擇最高分類機率,而FID則致力於最小化與預先計算的ImageNet Inception特徵統計之間的差異。

實驗結果顯示,該框架在多個基準測試中表現出色。在DrawBench測試中,LLM Grader評估證實了搜尋驗證方法能持續提升樣本品質。特別是ImageReward和Verifier Ensemble在各項指標上都取得了顯著進步,這歸功於它們精確的評估能力和與人類偏好的高度一致性。

這項研究不僅證實了基於搜尋的計算擴展方法的有效性,也揭示了不同驗證器的固有偏差,為未來開發更專業化的視覺生成任務驗證系統指明了方向。這項發現對於提升AI生成模型的整體表現具有重要意義。