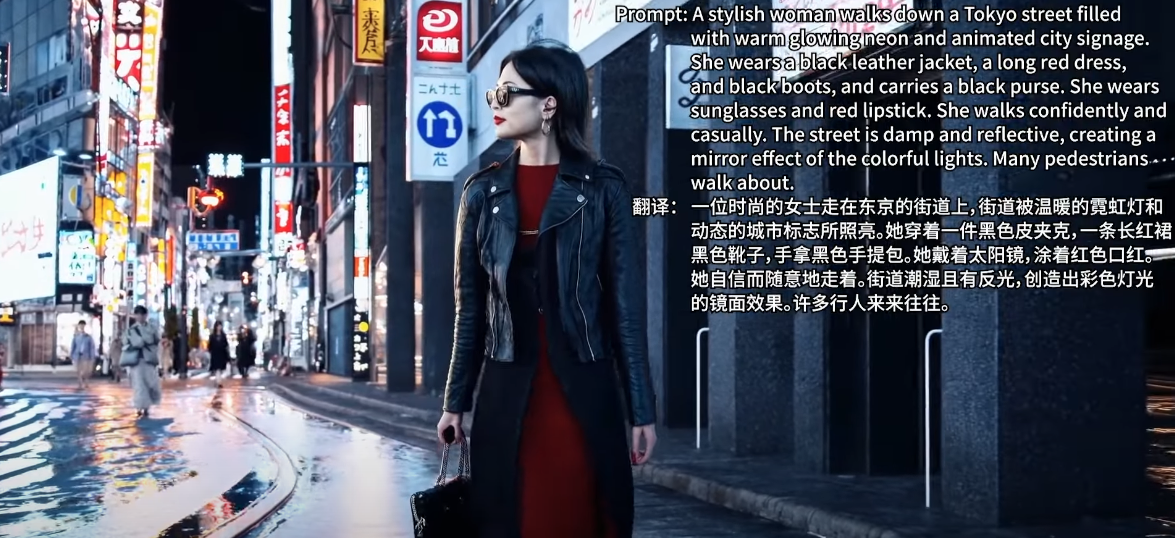

OpenAI發布了視頻生成模型Sora,這一消息讓AI圈直接沸騰了。 Sora通過簡單的提示詞生成高質量的視頻,甚至可以生成達到一分鐘的視頻,且視頻的穩定性和人物一致性都非常好。通過Sora生成的視頻,在13秒時,畫面還會自動切鏡頭,這種效果竟然是一次生成的,並非後期拼接。這讓我不禁感嘆Sora在人物細節上的處理,尤其是臉型、五官、髮型、眼鏡和耳環等細節,都做得幾乎完美無瑕。

我一直以來在介紹新技術或新產品時都比較謹慎,因為市面上有太多營銷號,一有什麼新產品發布就開始大肆宣傳,動輒說什麼“技術革命”“開年王炸”,搞得好像世界末日就要來了。因此我一般都會等幾天再出視頻,避免給大家帶來不必要的焦慮。說實話,這種方式也可能因為我有些懶吧,這也導致我的視頻播放量一直都一般。但這次Sora真的不一樣,雖然它還沒正式上線,仍然使用的是Transformer架構,但它確實值得我做一期視頻,畢竟它在AI視頻生成領域可以說是一次里程碑。

目前體驗Sora的唯一方式,就是去OpenAI CEO Sam Altman的推特下留言,偶爾能被選中體驗。官方目前給出的關於Sora的信息主要來自兩個頁面,一個是Sora的主頁,另一個是它的研究頁面。在Sora的主頁上,OpenAI清楚地說明Sora是一個文生視頻的AI模型,且頁面上展示的所有視頻都是由Sora直接生成的,並沒有經過任何後期的處理,包括剪輯和拼接。看到這個信息,我對視頻的表現有了更深的理解。比如,在看到13秒的鏡頭切換時,心裡都不禁產生了震撼,因為這並非後期操作,而是Sora一次性完成的。

Sora的目標或最終形態是構建一個“世界模型”,這個目標是極其雄心勃勃的。通過研究文獻,我發現Sora並不像其他AI視頻生成工具那樣依賴圖片生成模型,而是能夠在視頻中模擬現實世界的物理運動。傳統的AI視頻生成技術往往是依靠在每一幀之間插入預設的動作或骨骼圖,雖然看起來更自然,但本質上仍然是通過單張圖像的轉換來實現,而沒有涉及到物理信息。與之不同,Sora不僅能生成視頻,還能在視頻中處理物理運動,讓視頻看起來更為真實。

有趣的是,OpenAI在研究報告中提到,Sora在訓練時並沒有提供任何物理信息,而是通過大數據訓練得出結果。可以說,Sora的表現來自“數據堆積的奇蹟”。這也解釋了為什麼它能在生成的視頻中表現出如此自然的物理運動。與此同時,Sora能夠生成長達一分鐘的視頻,這一點也讓它在其他AI生成視頻產品中脫穎而出。目前市面上大多數視頻生成工具的生成時長都在幾秒鐘左右,而Sora能夠做到分鐘級別的視頻生成,其背後的計算量也是驚人的。

當我們進一步深入Sora的技術原理時,可以看到它是基於一個名為ViViT的視頻變換模型的。這個模型通過“patches”概念將圖像和視頻進行統一處理,通過複雜運算來得到視頻的特徵信息。這種技術的基礎依然是Transformer架構,不過它在視頻生成上的應用和圖片生成有著顯著的不同。通過這一技術,Sora能夠更精確地控制視頻的時間和空間特性,這也是為什麼Sora能在質量上超過現有工具的原因之一。

另外,Sora的亮點之一就是可以生成2K分辨率的圖片,而這遠超市面上現有的AI圖像生成工具。例如,SD XL生成的圖片分辨率只有1024x1024,而Sora直接能生成2K分辨率的圖像,這使得生成的圖像在細節表現上有了更豐富的層次感,尤其在毛髮、皮膚紋理和景深上,都展示出了極為真實的效果。

令人驚訝的是,Sora的生成不僅僅是在視覺上給人帶來衝擊,其背後的物理模擬能力也值得深思。例如,Sora可以模擬現實世界中的物理狀態,甚至能做到在人物遮擋住狗狗的情況下,狗狗依然能在人物走開後出現,展現了極強的空間一致性和時間一致性。這種能力讓人聯想到愛因斯坦和波爾討論的哲學問題——當沒有人觀察時,世界是否依然存在。這個小狗的例子讓我覺得,Sora彷彿擁有了對世界的某種自我理解能力,甚至像是創造了一個模擬世界一樣。

不過,Sora目前仍然處於測試階段,因此我們只能期待它的正式發布。雖然它在模擬物理和生成視頻方面展現了巨大潛力,但仍有許多局限性,像玻璃破碎、狗的裂變、籃球穿模等現像都表現不夠完美。這也可能意味著Sora對世界的理解並不完全符合我們當前的物理規則。

Sora在AI視頻生成領域無疑是一個巨大的突破。它不僅能生成質量極高的視頻,還能在模擬物理和時間一致性方面取得顯著進展。儘管它仍有不足之處,但隨著技術的不斷發展,我相信Sora在未來會成為視頻生成領域的標杆。對於那些有興趣深入了解的人,Sora的潛力無疑值得關注。