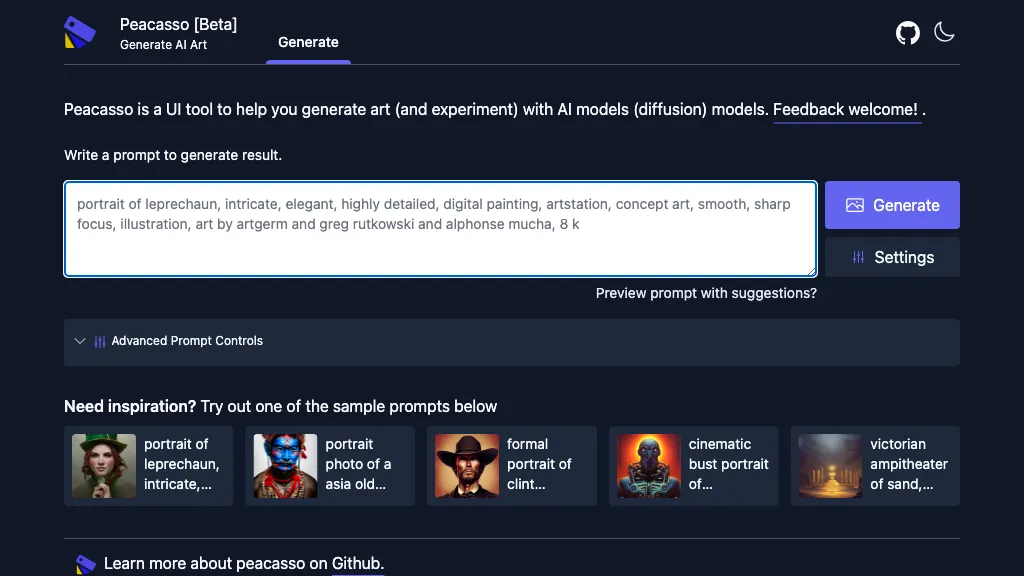

ComfyUI是一款基於節點(Node-based)的圖形用戶界面(GUI),專為Stable Diffusion設計。它通過模塊化方式讓用戶自由組合不同的圖像處理節點,打造高度靈活的AI 生成圖像工作流。相比AUTOMATIC1111等其他Web UI, ComfyUI更輕量化、運行速度更快,且具備可視化數據流的特點。然而, ComfyUI的上手難度較高,需要一定的學習成本。

如果你希望對Stable Diffusion 生成流程進行深入自定義,並能清晰掌控數據流向, ComfyUI是非常值得嘗試的工具。

ComfyUI支持Windows、Mac 和Linux ,安裝方式略有不同:

✅ Windows 用戶:可以直接從官方文檔下載ComfyUI安裝包,解壓後運行ComfyUI .exe即可。

✅ Mac/Linux 用戶:需要通過命令行手動安裝,先下載ComfyUI並解壓,再根據官方指南配置Python 依賴環境。

安裝完成後,在瀏覽器中訪問** http://127.0.0.1:8188/**,即可進入ComfyUI 的主界面。

ComfyUI官方下載地址: https://www.comfy.org/zh-cn/download

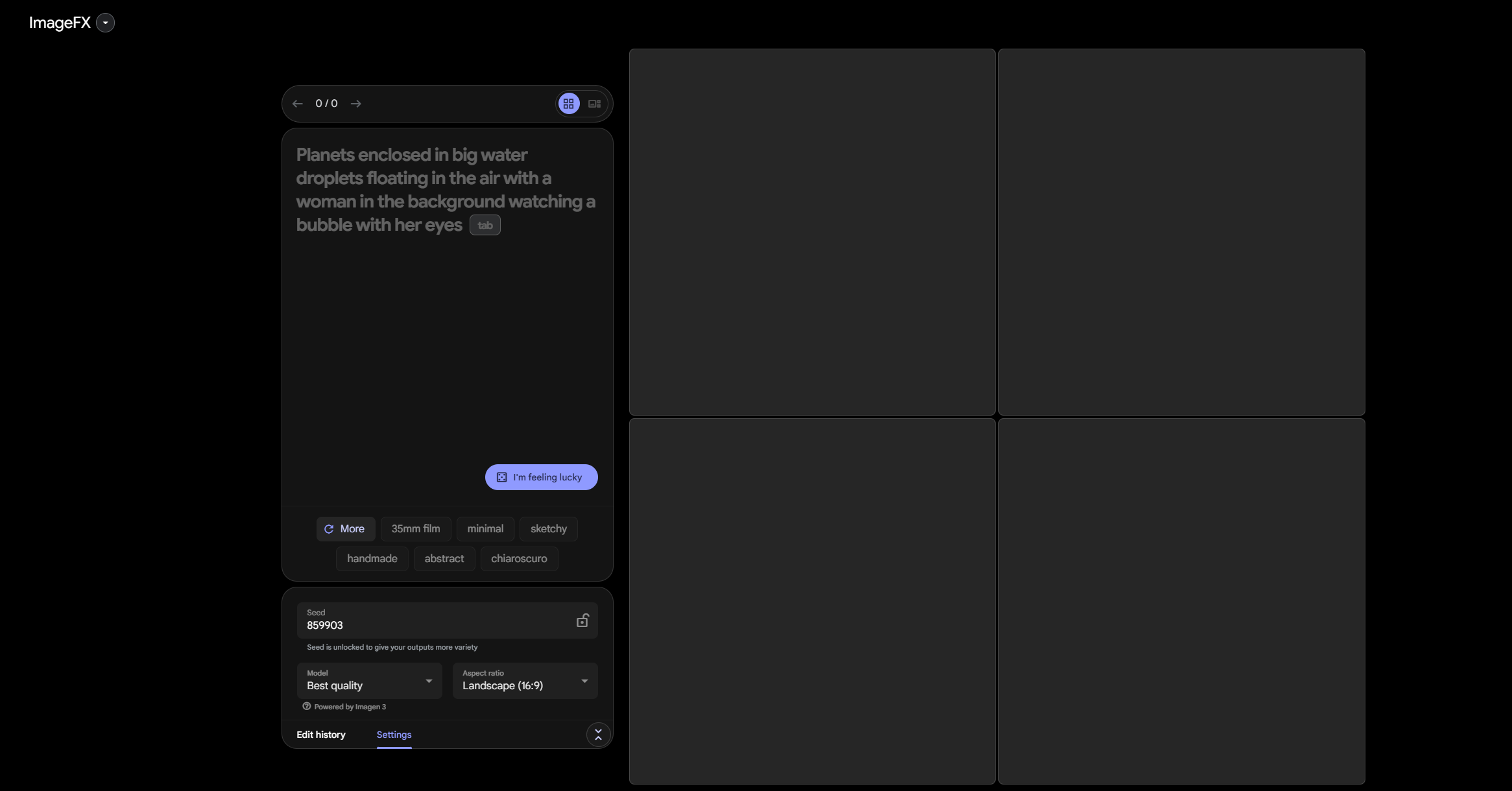

在ComfyUI中,圖像生成是基於“節點連接”的方式進行的。以下是文本生成圖像(Text-to-Image)的基本步驟:

1️⃣選擇模型:在Load Checkpoint節點中,加載已下載的Stable Diffusion 模型。

2️⃣輸入提示詞:在CLIP Text Encode (Prompt)節點中,輸入正向提示詞(Positive Prompt) 和負向提示詞(Negative Prompt)。

3️⃣運行生成:點擊Queue Prompt按鈕,啟動圖像生成。界面中綠色邊框的節點會依次激活,表示當前處理進度。

提示: ComfyUI支持完全可視化的工作流管理,可以直觀調整不同的參數和節點設置,實現更精細的圖像控制。

ComfyUI本身不包含任何AI 生成模型,因此你需要手動下載合適的模型文件,並存放到ComfyUI的模型目錄( models/checkpoints/ )。

模型下載來源:可以在Hugging Face搜索Stable Diffusion相關模型(如SDXL、DreamShaper 等)。

下載方式:部分大模型需要使用git-lfs下載,或者直接通過Access Token 訪問。

模型格式: ComfyUI兼容.ckpt和.safetensors文件格式,下載後解壓並放置到models/checkpoints/文件夾。

推薦模型:

stable-diffusion-3-medium :適用於高質量通用圖像生成

dreamshaper :專注於動漫和藝術風格

SDXL :高分辨率圖像生成

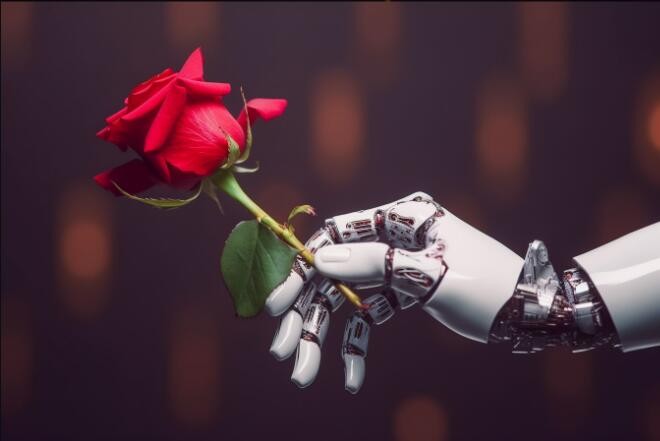

案例1:生成風景畫

選擇stable-diffusion-3-medium模型

正向提示詞: A beautiful landscape, mountains, rivers, blue sky, clouds

負向提示詞: blurry, low quality, distortion

運行生成,即可得到一張高清風景圖

案例2:生成動漫人物

選擇dreamshaper模型

正向提示詞: anime style, cute girl, long flowing hair

負向提示詞: ugly, deformed

運行後獲得精美的動漫角色圖像

案例3:圖像修復(Inpainting)

選擇一張已有圖片

在Inpainting 節點選取要修復的區域

restore missing parts with natural textures

運行後, ComfyUI將自動填補缺失區域

✅ Outpainting(圖像擴展) :在已有圖片基礎上生成額外內容,擴展畫面邊界。

✅ Upscale(圖像放大) :提高分辨率,使圖像更加清晰。

✅ Manager(模型管理) :快速切換和管理下載的模型文件。

✅ Embeddings(嵌入向量) :用於微調和優化提示詞效果,提高AI 生成質量。

總結: ComfyUI是一個高度靈活、可視化、模塊化的Stable Diffusion 界面,適合喜歡探索AI 生成細節的用戶。如果你對AI 圖像生成感興趣,值得嘗試!