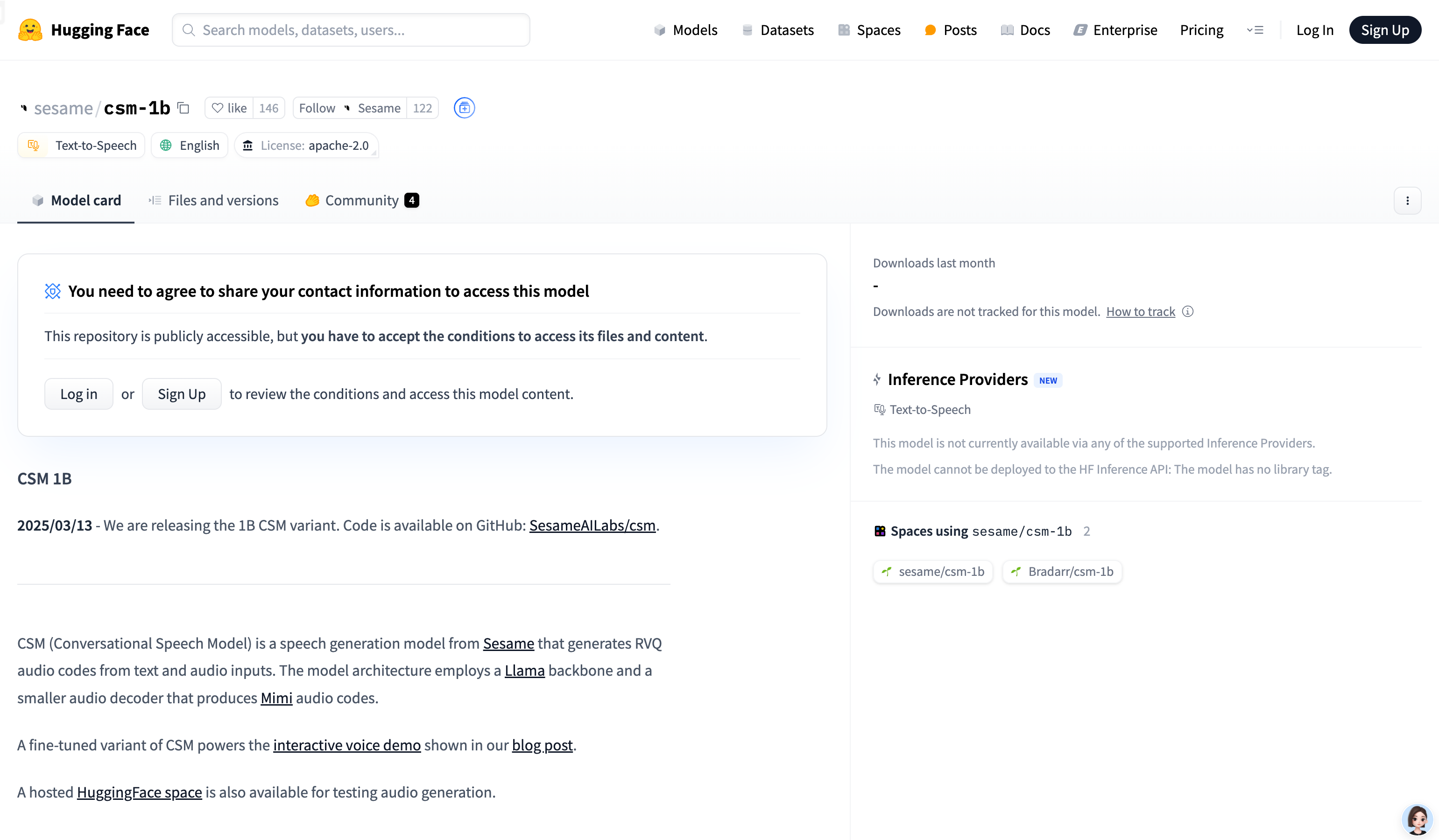

CSM 1B

解鎖高質量語音合成!基於Llama架構的CSM 1B模型,支持文本&音頻輸入,適用於多說話人場景。開源工具,助力研究與教育,快來體驗吧!

CSM 1B是一個基於Llama 架構的語音生成模型,能夠從文本和音頻輸入中生成RVQ 音頻代碼。該模型主要應用於語音合成領域,具有高質量的語音生成能力。其優勢在於能夠處理多說話人的對話場景,並通過上下文信息生成自然流暢的語音。該模型開源,旨在為研究和教育目的提供支持,但明確禁止用於冒充、欺詐或非法活動。

需求人群:

"該模型適合需要高質量語音合成的研究人員、開發者以及教育工作者。它能夠為語音交互應用、語音合成研究和教育場景提供技術支持。"

使用場景示例:

在語音交互應用中,為虛擬助手生成自然語音

用於語音合成研究,探索高質量語音生成技術

在教育場景中,為語言學習生成語音示例

產品特色:

支持從文本生成高質量語音

可處理多說話人的對話場景

通過上下文信息生成更自然的語音

開源模型,便於研究和教育使用

支持多種語言(但非英語效果可能不佳)

使用教程:

1. 克隆模型倉庫:`git clone [email protected]:SesameAILabs/csm.git`

2. 設置虛擬環境並安裝依賴:`python3.10 -m venv .venv` 和`pip install -r requirements.txt`

3. 下載模型文件:`hf_hub_download(repo_id="sesame/csm-1b", filename="ckpt.pt")`

4. 加載模型並生成語音:調用`load_csm_1b` 和`generate` 方法生成音頻

5. 保存生成的音頻:使用`torchaudio.save` 保存音頻文件