FLUX.1-dev-IP-Adapter是一個基於FLUX.1-dev模型的IP-Adapter,由InstantX Team研發。該模型能夠將圖像工作處理得像文本一樣靈活,使得圖像生成和編輯更加高效和直觀。它支持圖像參考,但不適用於細粒度的風格轉換或角色一致性。模型在10M開源數據集上訓練,使用128的批量大小和80K的訓練步驟。該模型在圖像生成領域具有創新性,能夠提供多樣化的圖像生成解決方案,但可能存在風格或概念覆蓋不足的問題。

需求人群:

"目標受眾為圖像生成領域的研究人員、開發者和愛好者。他們可以利用FLUX.1-dev-IP-Adapter進行圖像生成和編輯,探索新的圖像處理技術,以及在藝術創作和設計中實現創新。"

使用場景示例:

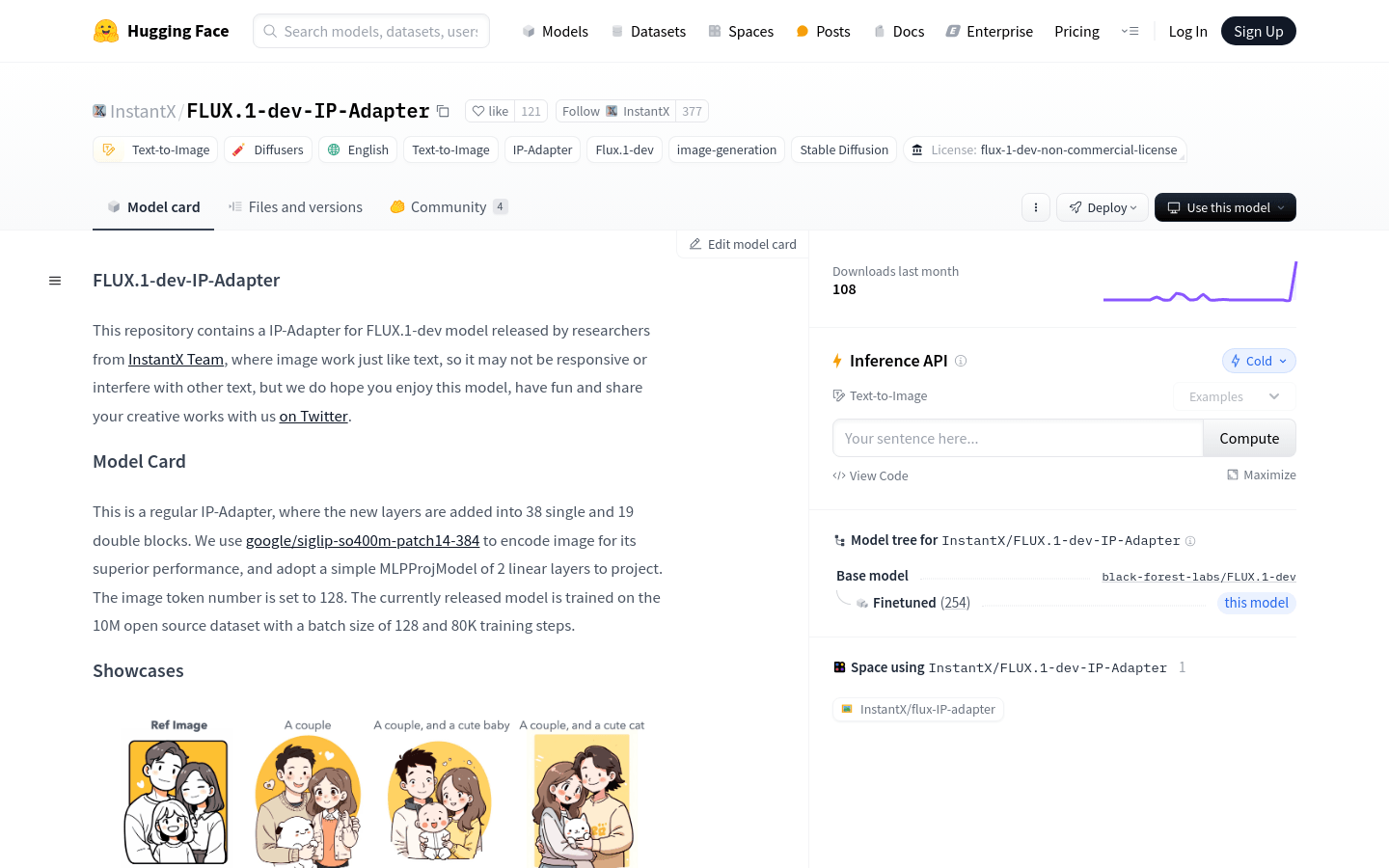

案例1:使用FLUX.1-dev-IP-Adapter生成具有特定風格或主題的圖像。

案例2:在藝術創作中,利用該模型將文本描述轉換為視覺圖像。

案例3:在設計領域,通過模型快速迭代和調整圖像設計,提高工作效率。

產品特色:

• 支持圖像參考:模型能夠理解和使用圖像作為參考,進行圖像生成。

• 靈活的圖像處理:圖像工作如文本,提高了圖像編輯的靈活性。

• 高性能編碼:使用google/siglip-so400m-patch14-384模型編碼圖像,以獲得更優的性能。

• 簡單的MLPProjModel:採用2層線性層進行圖像投影,簡化了模型結構。

• 訓練數據集:在10M開源數據集上進行訓練,提高了模型的泛化能力。

• 批量大小和訓練步驟:使用128的批量大小和80K的訓練步驟,優化了訓練過程。

• 社區互動:模型頁面上的社區討論功能,增強了用戶之間的交流和協作。

使用教程:

1. 訪問Hugging Face網站並蒐索FLUX.1-dev-IP-Adapter模型。

2. 閱讀模型卡,了解模型的詳細信息和使用限制。

3. 下載或克隆模型的代碼庫,準備進行本地部署。

4. 根據提供的代碼示例,設置環境並導入必要的庫。

5. 加載模型和圖像編碼器,準備進行圖像生成。

6. 定義生成圖像的提示(prompt),並調整生成參數。

7. 使用模型生成圖像,並保存結果。

8. 分享和討論生成的圖像,參與社區互動。