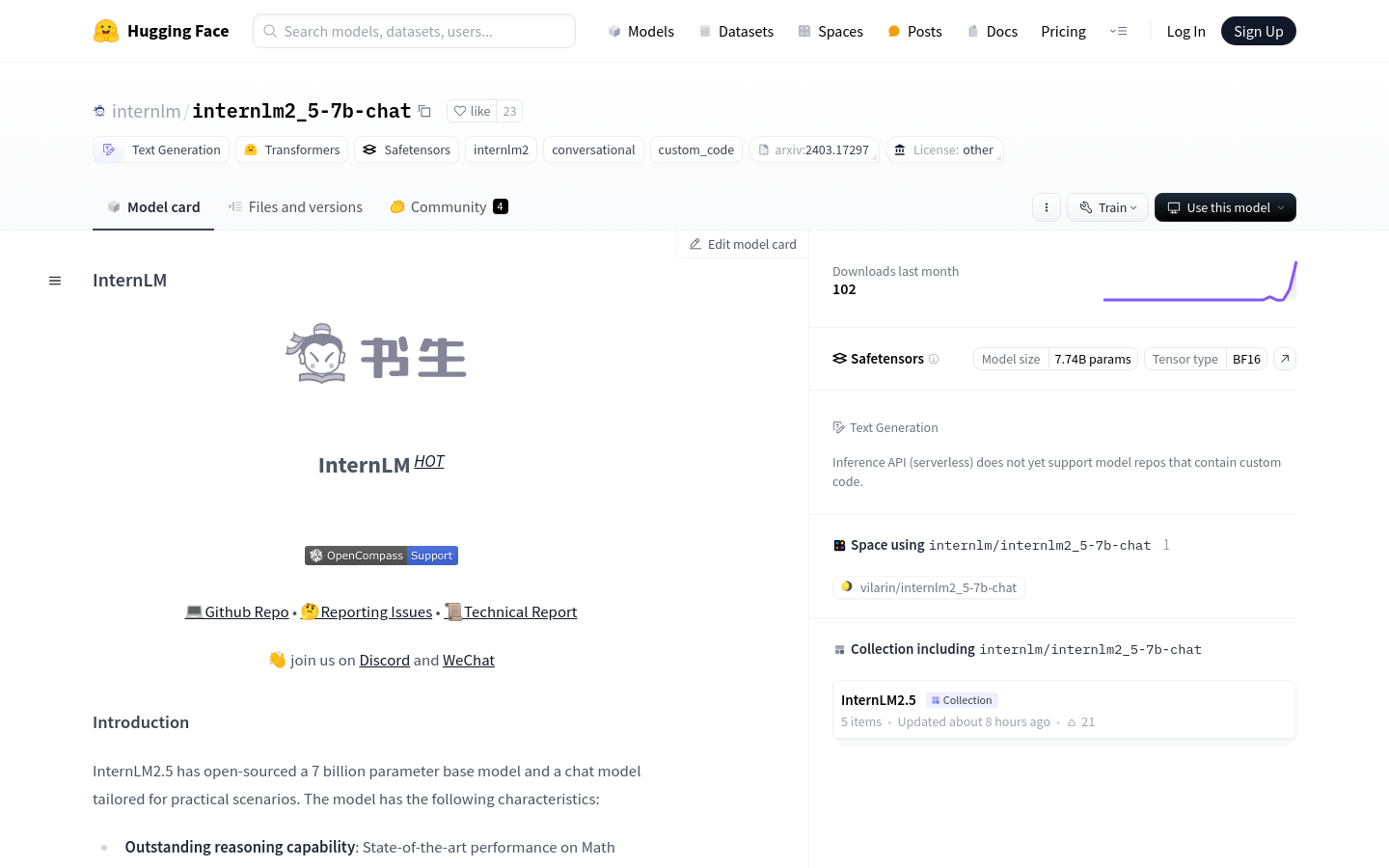

InternLM2.5-7B-Chat

InternLM25-7B-Chat 提供先進的 AI 聊天功能,專為無縫智慧對話而設計

InternLM2.5-7B-Chat產品介紹

InternLM2.5-7B-Chat是一個開源的7 億參數中文對話模型,專為實用場景設計。它具有卓越的推理能力,在數學推理方面優於Llama3 和Gemma2-9B 等模型。 模型支援從大量網頁收集資訊並進行分析推理,具備強大的工具呼叫能力,並支援超長上下文窗口,適合處理長文本和建立複雜任務智能體。

目標用戶

此模型的目標使用者是需要進行複雜對話處理、長文本分析和資訊收集的企業和研究機構。 它非常適合建立智慧客服、個人助理和教育輔導等應用。

使用場景範例

智慧客服系統,提供24 小時自動回覆服務

個人助理,幫助用戶管理日程和提醒重要事項

教育領域,輔助學生學習,提供個人化學習建議與答疑

產品特性

優異的數學推理能力,超越同量級模型

支援超長上下文窗口,適合長文本處理

可從多個網頁收集資訊並進行分析推理

具備指令理解、工具篩選與結果反思能力

支援透過LMDeploy 和vLLM 部署模型並提供API 服務

程式碼遵循Apache-2.0 協定開源,模型權重對學術研究完全開放

使用教程

1 載入InternLM2.5-7B-Chat模型

2 設定模型參數,選擇精度(float16 或float32)

3 使用chat 或stream_chat 介面進行對話或串流生成

4 透過LMDeploy 或vLLM 部署模型,實現本機或雲端推理

5 發送請求獲取結果

6 根據應用場景對結果進行後處理