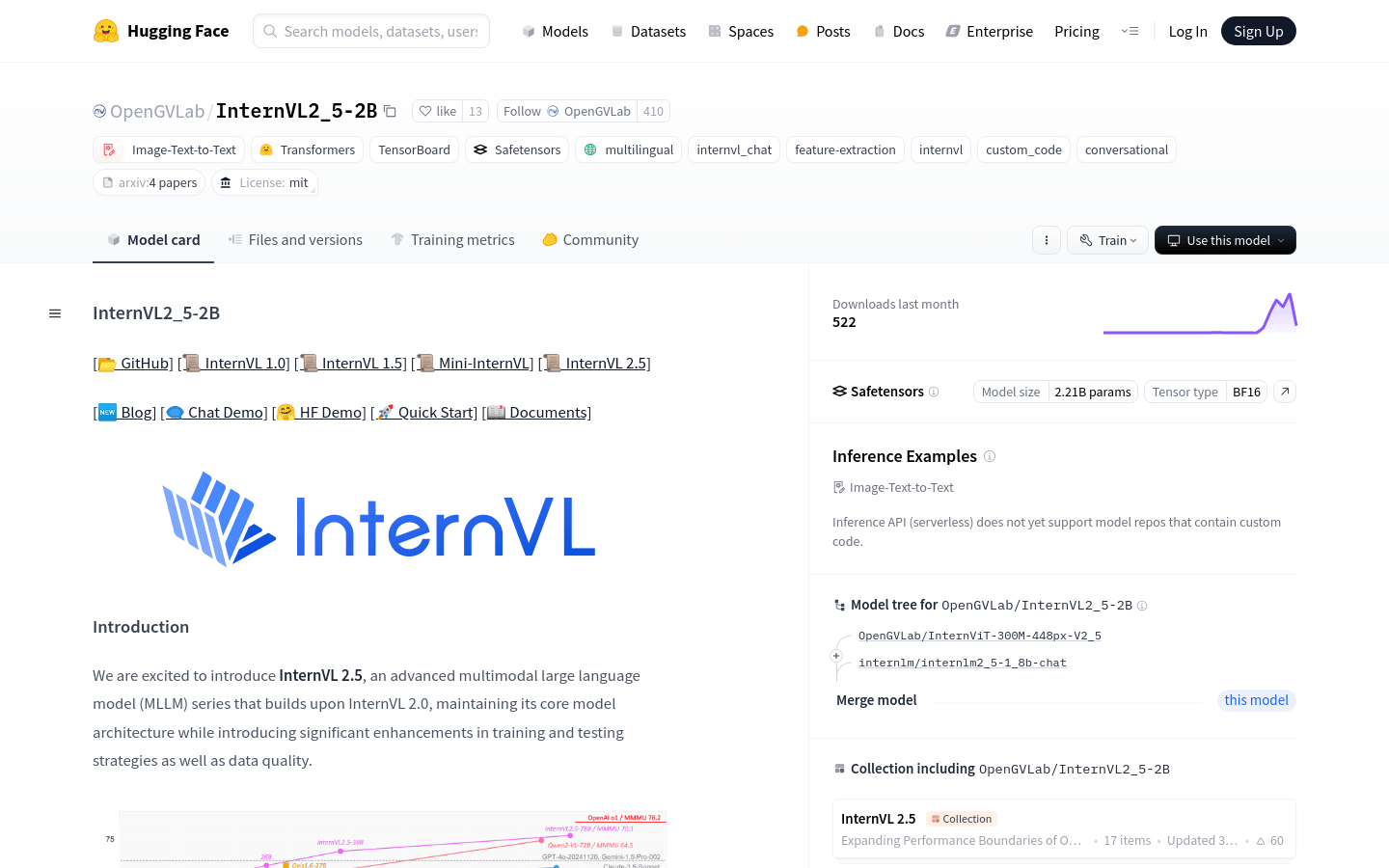

InternVL 2.5 是一个先进的多模态大型语言模型系列,它在InternVL 2.0的基础上,通过引入显著的训练和测试策略增强以及数据质量提升,维持了其核心模型架构。该模型整合了新增量预训练的InternViT与各种预训练的大型语言模型,例如InternLM 2.5和Qwen 2.5,使用随机初始化的MLP投影器。InternVL 2.5 支持多图像和视频数据,具备动态高分辨率训练方法,能够在处理多模态数据时提供更好的性能。

需求人群:

"目标受众为研究人员、开发者和企业,特别是那些需要处理和理解多模态数据,如图像和文本结合的应用场景。InternVL2_5-2B以其强大的多模态理解和生成能力,适合于开发智能图像-文本处理应用,如图像描述、视觉问答和多模态对话系统。"

使用场景示例:

使用InternVL2_5-2B模型为电商平台生成产品图像的详细描述。

在教育领域,利用该模型提供图像辅助的语言学习材料,增强学习体验。

在安全监控领域,通过视频理解能力,自动识别和响应异常行为。

产品特色:

支持多模态数据的动态高分辨率训练方法,增强模型处理多图像和视频数据的能力。

采用'ViT-MLP-LLM'模型架构,整合视觉编码器和语言模型,通过MLP投影器进行跨模态交互。

提供多阶段训练管道,包括MLP预热、视觉编码器增量学习和全模型指令调整,以优化模型的多模态能力。

引入渐进式扩展策略,有效对齐视觉编码器与大型语言模型,减少冗余,提高训练效率。

采用随机JPEG压缩和损失重新加权技术,提高模型对噪声图像的鲁棒性并平衡不同长度响应的NTP损失。

设计了高效的数据过滤管道,去除低质量样本,确保模型训练的数据质量。

使用教程:

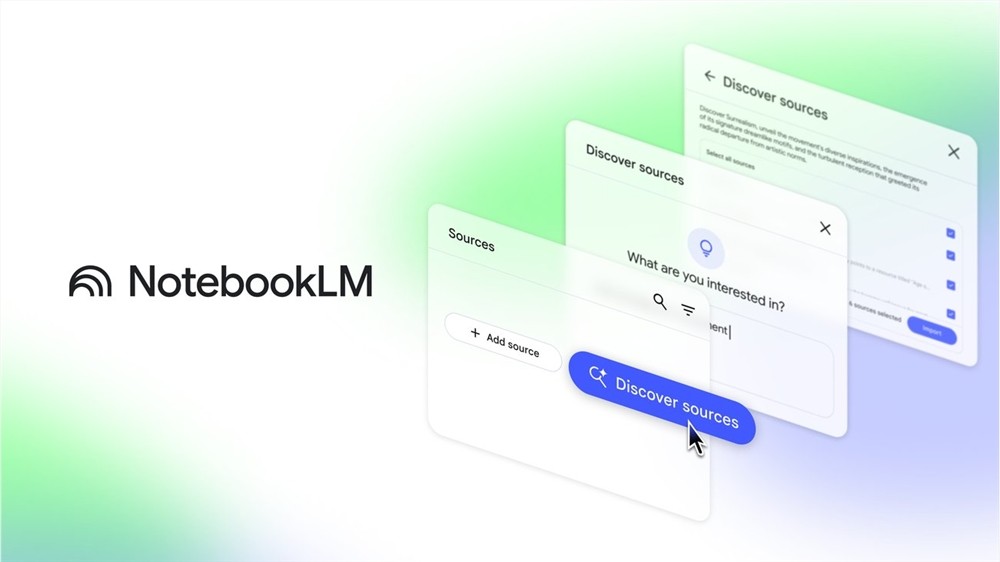

1. 访问Hugging Face网站并搜索InternVL2_5-2B模型。

2. 根据需要的应用场景,下载或直接在平台上使用模型。

3. 准备输入数据,包括图像和相关文本。

4. 使用模型的API接口,输入数据并获取模型输出。

5. 根据输出结果进行后处理,如文本生成的格式化或图像识别结果的解析。

6. 将模型输出集成到最终的应用或服务中。