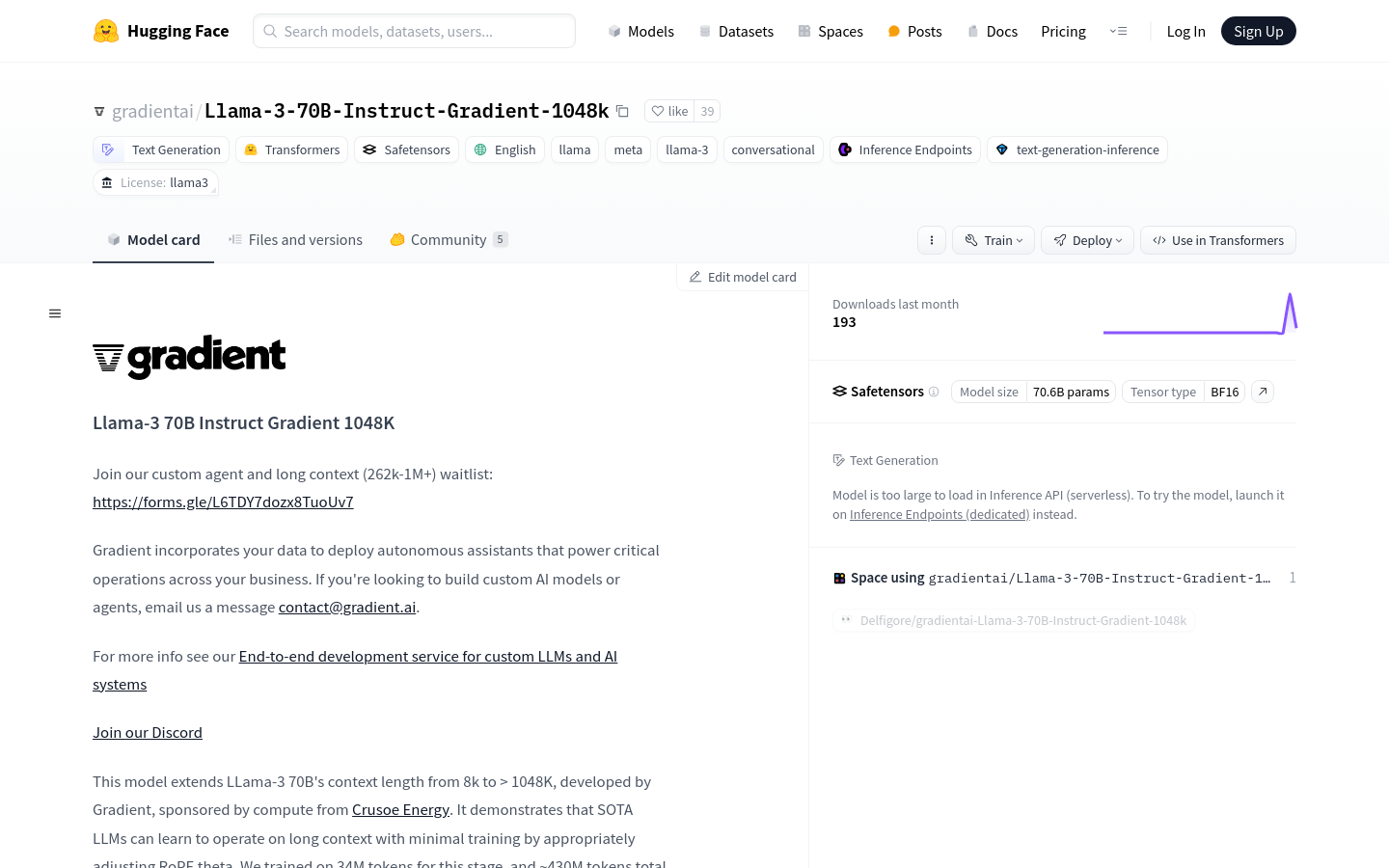

Llama-3 70B Instruct Gradient 1048k是一款由Gradient AI團隊開發的先進語言模型,它通過擴展上下文長度至超過1048K,展示了SOTA(State of the Art)語言模型在經過適當調整後能夠學習處理長文本的能力。該模型使用了NTK-aware插值和RingAttention技術,以及EasyContext Blockwise RingAttention庫,以高效地在高性能計算集群上進行訓練。它在商業和研究用途中具有廣泛的應用潛力,尤其是在需要長文本處理和生成的場景中。

需求人群:

["適用於需要處理大量文本和復雜對話的商業智能助手。","適合研究人員在自然語言處理領域的實驗和模型訓練。","對於開發者來說,可以用於創建定制的AI模型或代理,以支持關鍵業務操作。"]

使用場景示例:

作為聊天機器人,提供客戶服務支持。

在內容創作中,生成創意文案和故事。

在教育領域,輔助語言學習和文本分析。

產品特色:

支持長文本生成,上下文長度擴展至1048K。

基於Meta Llama 3家族的大型語言模型,優化了對話使用案例。

使用NTK-aware插值和RingAttention技術進行訓練。

在Crusoe Energy的高性能L40S集群上進行訓練,以支持長文本處理。

生成的長文本通過數據增強和聊天數據集進行微調。

模型在安全性和性能上進行了細緻的調整,以減少誤拒絕並提高用戶體驗。

使用教程:

步驟1:訪問Hugging Face模型庫中的Llama-3 70B Instruct Gradient 1048k頁面。

步驟2:根據需求選擇使用transformers庫或原始llama3代碼庫進行模型加載。

步驟3:通過提供的代碼片段,配置模型參數並加載模型。

步驟4:準備輸入文本或對話消息,並使用模型的tokenizer進行處理。

步驟5:設置生成文本的參數,如最大新令牌數、溫度等。

步驟6:調用模型生成文本或執行特定任務。

步驟7:根據輸出結果進行後續處理或展示。