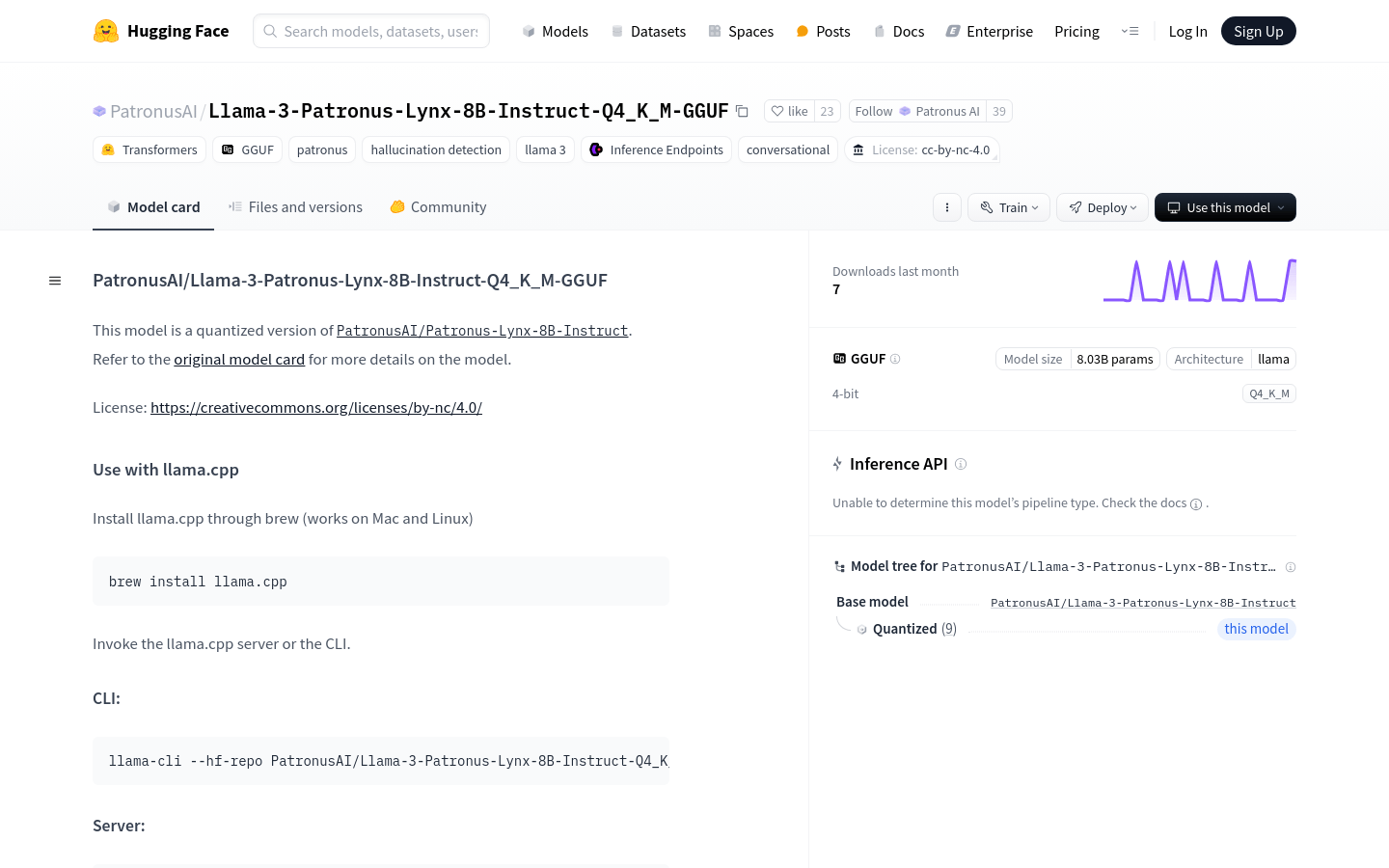

Llama-3-Patronus-Lynx-8B-Instruct-Q4_K_M-GGUF

一個免費的4位大型語言模型,具有8.03b參數,適用於資源受限系統上的自然語言處理任務。

該模型是量化版大型語言模型,採用4位量化技術,降低存儲與計算需求,適用於自然語言處理,參數量8.03B,免費且可用於非商業用途,適合資源受限環境下高性能語言應用需求者。

需求人群:

"目標受眾為研究人員、開發者和企業。研究人員可用於探索自然語言處理研究;開發者便於開發相關應用;企業可在內部資源受限服務器等部署用於文本處理等工作。"

使用場景示例:

1. 應用於智能客服系統,生成準確文本回复。

2. 在內容創作平台輔助創作文章、故事等創意文本。

3. 助力企業知識管理系統實現文檔摘要和問答自動化。

產品特色:

1. 支持通過llama.cpp進行命令行界面(CLI)推理,方便快捷操作。

2. 能通過llama.cpp搭建服務器推理,利於服務部署。

3. 參數量達8.03B,具備較強語言理解與生成能力,滿足文本處理需求。

4. 採用4位量化技術,有效優化存儲和計算效率,節省資源。

5. 適用於文本生成、問答等自然語言處理任務,應用場景廣泛。

6. 基於特定架構,可通過相關方式進行推理,易於上手使用。

7. 允許在非商業用途下自由使用和分享,使用限制明確。

使用教程:

1. 通過brew安裝llama.cpp(適用於Mac和Linux)。

2. 使用llama-cli命令行工具進行推理,按相應格式輸入參數。

3. 搭建llama-server進行推理服務,配置對應參數。

4. 也可直接參照llama.cpp倉庫中的使用步驟進行推理。

5. 克隆llama.cpp倉庫,進入目錄並按要求構建。

6. 通過構建好的二進製文件運行推理。