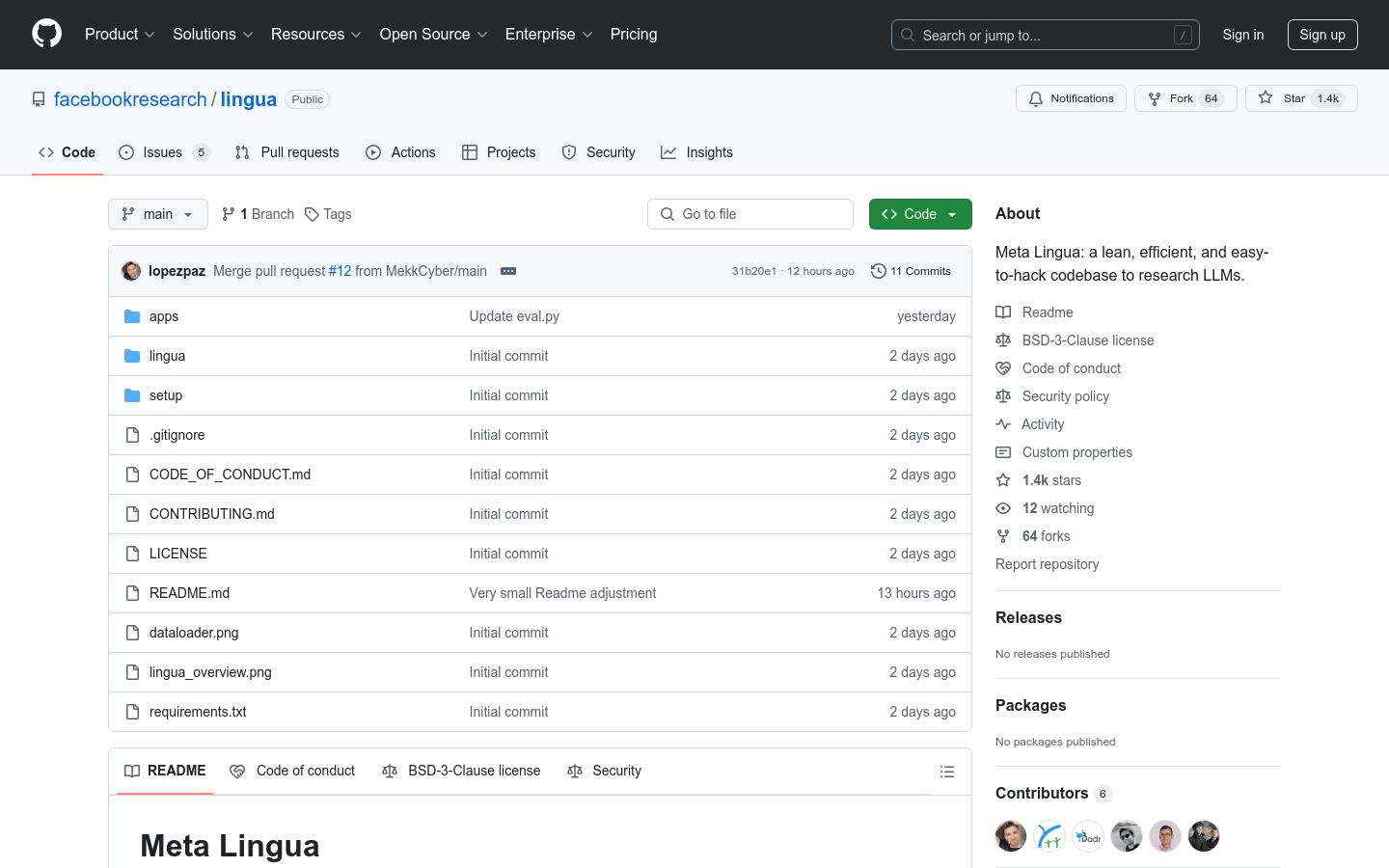

Meta Lingua

Meta Lingua是一個靈活的基於Pytorch的圖書館,用於培訓和評估大型語言模型,非常適合NLP和ML的研究人員和開發人員。

什麼是Meta Lingua ?

Meta Lingua是用於研究目的的大型語言模型(LLM)(LLMS)的輕巧和高效的圖書館。它使用Pytorch組件構建,它使研究人員可以輕鬆地嘗試新的體系結構,損失功能和數據集。圖書館支持端到端培訓,推理和評估,提供了分析模型性能和穩定性的工具。

目標受眾:

它針對自然語言處理和機器學習的研究人員,開發人員和學生。它的靈活性和易用性使其非常適合探索新穎的LLM體系結構和培訓策略。

用法方案:

研究人員可以訓練自定義LLM進行文本生成任務。

開發人員可以在多個GPU中優化模型性能和資源利用率。

學生可以學習如何建立和培訓大型語言模型。

關鍵功能:

模型是使用Pytorch組件構建的,使修改和嘗試新體系結構變得易於修改。

支持各種並行策略,例如數據並行性,模型並行性和激活檢查點。

為多GPU設置提供分佈式培訓支持。

包括用於培訓前LLM的數據加載器。

整合性能分析工具以評估記憶和計算效率。

提供模型檢查點管理,用於在不同數量的GPU上保存和加載模型。

支持配置文件和命令行參數,以進行靈活的實驗設置和迭代。

入門:

1。克隆Meta Lingua存儲庫到您本地的機器。

2。導航到存儲庫目錄並運行設置腳本以創建環境。

3。激活創建的環境。

4。使用提供的或自定義配置來啟動培訓腳本。

5。監視訓練過程並根據需要調整配置參數。

6。使用評估腳本在給定的檢查點評估模型。

7。利用分析工具來檢查模型的性能和資源使用情況。