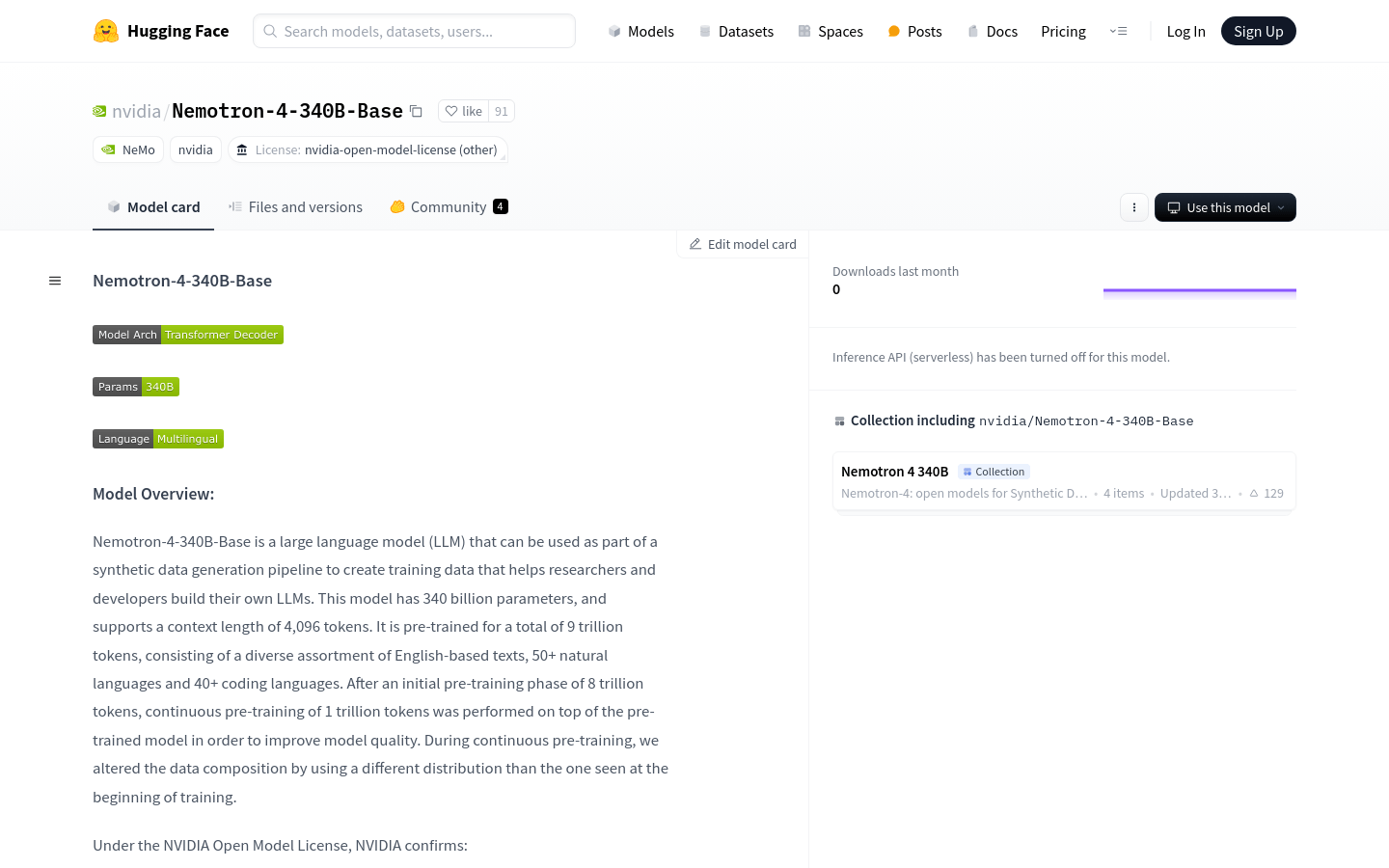

Nemotron-4-340B-Base

Nemotron-4-340B-Base是NVIDIA的340B參數模型,支持50多種語言和40多種編程語言,用於文本生成和代碼創建,非常適合研究人員和開發人員。

什麼是Nemotron-4-340B-Base ?

Nemotron-4-340B-Base是由NVIDIA開發的大型語言模型,具有3400億個參數。它支持多達4096個上下文令牌,非常適合生成合成數據,以幫助研究人員和開發人員構建自己的大型語言模型。該模型已在50多種自然語言和40多種編程語言中進行了9萬億個令牌的預培訓。

目標受眾:

主要受眾包括需要建立或培訓自己的大語言模型的研究人員和開發人員。它對多種語言和編程語言的支持使其適合開發多語言應用程序和代碼生成工具。

示例場景:

研究人員可以使用Nemotron-4-340B-Base來生成針對領域特定語言模型的培訓數據。

開發人員可以利用模型的多語言功能來創建支持多種語言的聊天機器人。

教育機構可以採用該模型來通過生成示例代碼來解釋複雜概念來幫助學生學習編程。

關鍵功能:

支持50多種自然語言和40多種編程語言。

與NVIDIA NEMO框架兼容,提供參數有效的微調和模型對齊工具。

使用分組的疑問和旋轉位置嵌入技術。

預先訓練9萬億個代幣,包括各種英語文本。

支持BF16推理,可以在各種硬件配置上部署。

提供5桿和零拍的性能評估,以展示其多語言理解和代碼生成能力。

用法指南:

1。下載並安裝NVIDIA NEMO框架。

2。設置所需的硬件環境,包括支持BF16推理的GPU。

3。創建一個Python腳本以與已部署的模型進行交互。

4。寫一個bash腳本以啟動推理服務器。

5。使用slurm作業調度程序分發模型並通過多個節點將推理服務器關聯。

6.通過Python腳本發送文本生成請求,並從模型中獲取響應。