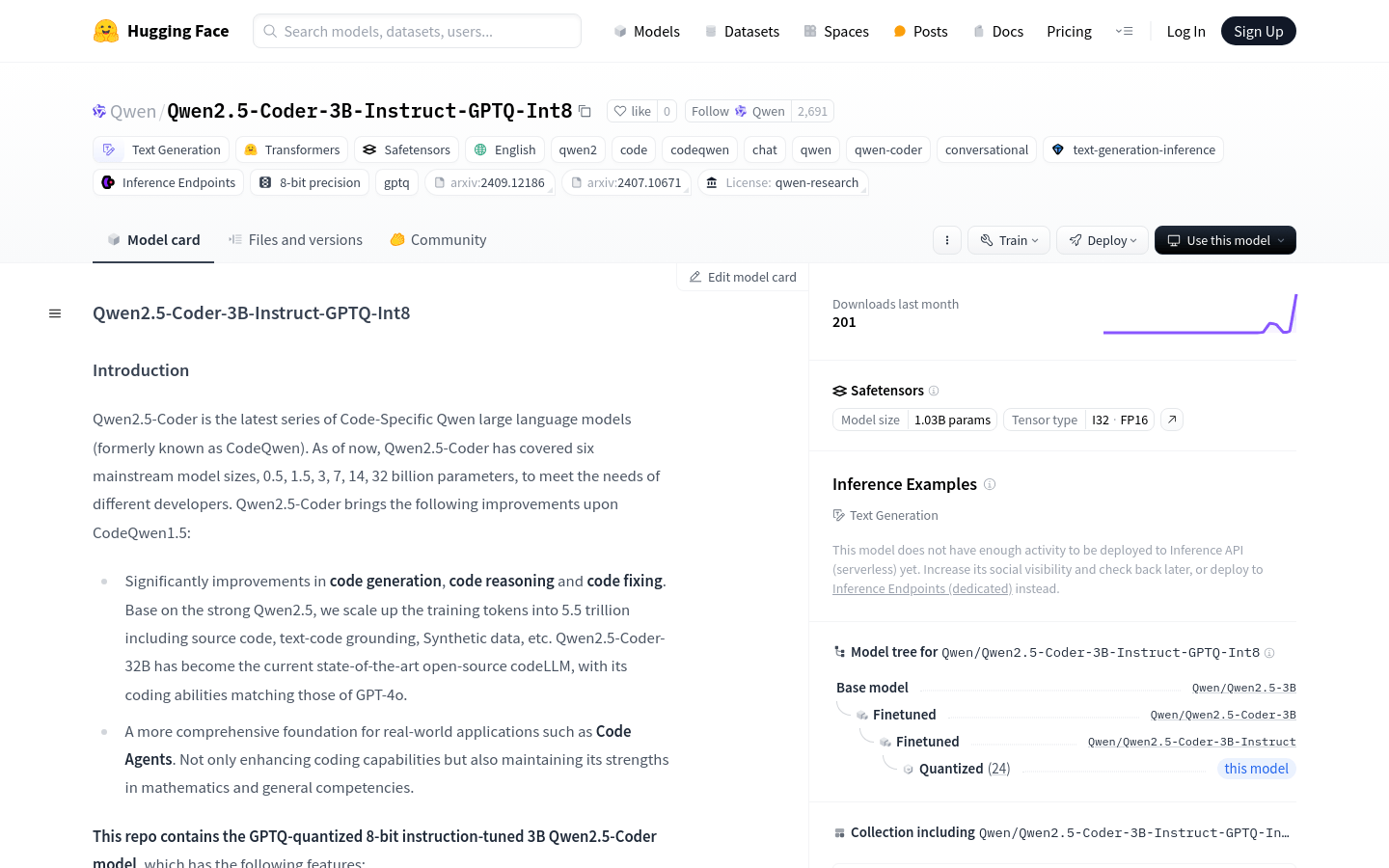

Qwen2.5-Coder-3B-Instruct-GPTQ-Int8 是 Qwen2.5-Coder 系列中的一种大型语言模型,专门针对代码生成、代码推理和代码修复进行了优化。该模型基于 Qwen2.5,训练数据包括源代码、文本代码关联、合成数据等,达到了5.5万亿个训练令牌。Qwen2.5-Coder-32B 已成为当前最先进的开源代码大型语言模型,其编码能力与 GPT-4o 相匹配。该模型还为现实世界中的应用提供了更全面的基础,如代码代理,不仅增强了编码能力,还保持了在数学和通用能力方面的优势。

目标受众

目标受众为软件开发者、编程爱好者和数据科学家。该产品适合他们,因为它提供了强大的代码辅助功能,可以显著提高编程效率和代码质量,同时支持长代码片段的处理,适合复杂的编程任务。

使用场景示例

开发者:使用该模型生成排序算法的代码。

数据科学家:利用模型进行大规模代码分析和优化。

教育者:将模型集成到编程教学中,帮助学生理解和学习代码逻辑。

产品特色

代码生成:显著提升代码生成能力,帮助开发者快速实现代码逻辑。

代码推理:增强模型对代码逻辑的理解,提高代码分析的准确性。

代码修复:自动检测并修复代码中的错误,提升代码质量。

全参数量覆盖:提供从0.5亿到32亿参数的不同模型大小,满足不同开发者需求。

GPTQ量化:8位量化技术,优化模型性能和内存使用。

长上下文支持:支持长达32768个token的上下文长度,适合处理长代码片段。

多语言支持:主要支持英文,适用于国际化开发环境。

开源:模型开源,便于社区贡献和进一步的研究。

使用教程

1. 安装 Hugging Face 的 transformers 库,并确保版本至少为 4.37.0。

2. 使用 AutoModelForCausalLM 和 AutoTokenizer 从 Hugging Face Hub 加载模型和分词器。

3. 准备输入提示,例如编写一个快速排序算法。

4. 使用 tokenizer.applychattemplate 方法处理输入消息,并生成模型输入。

5. 将生成的模型输入传递给模型,并设置 maxnewtokens 参数以控制生成的代码长度。

6. 模型生成代码后,使用 tokenizer.batch_decode 方法将生成的 token 转换为文本。

7. 根据需要对生成的代码进行进一步的测试和调试。