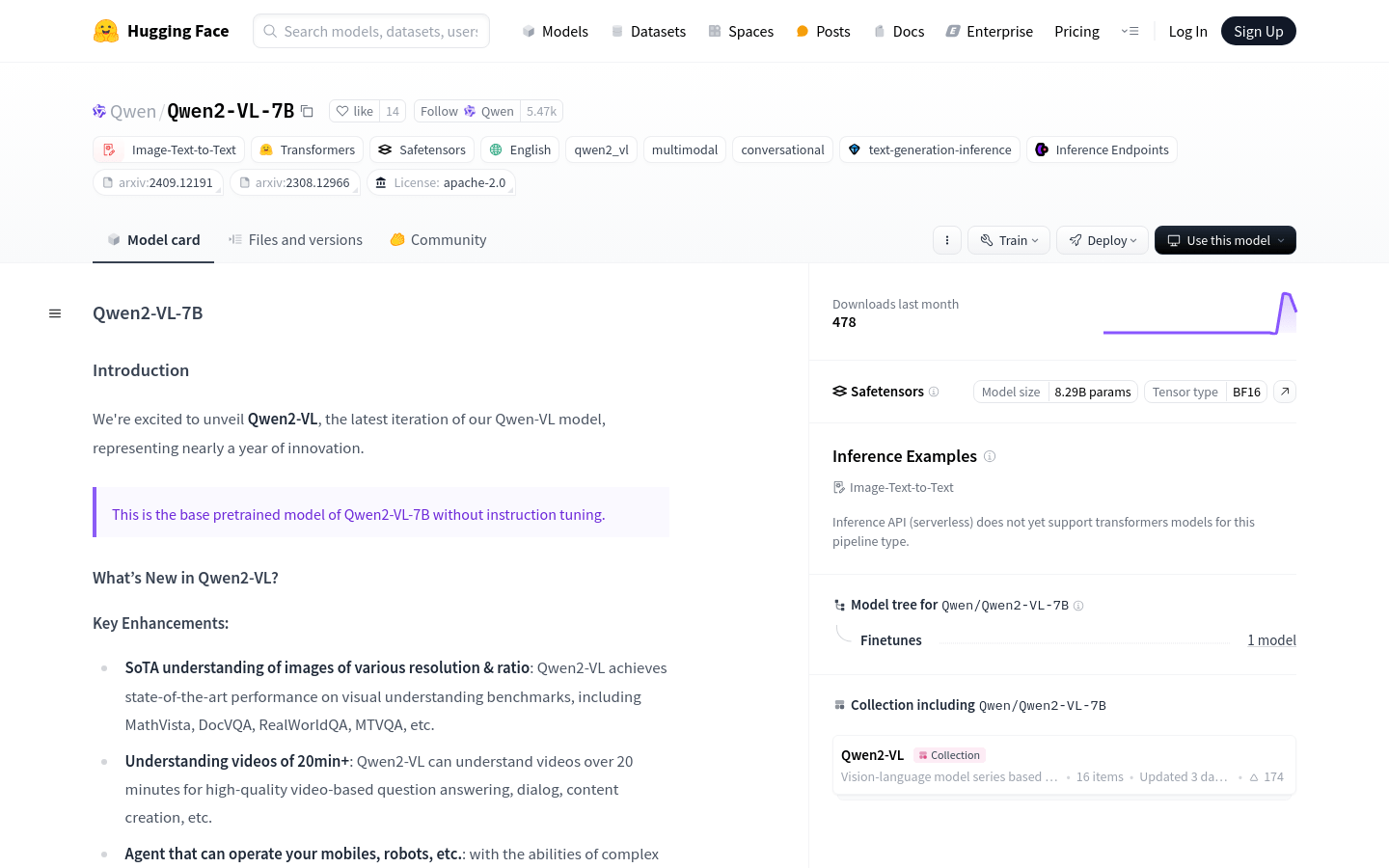

Qwen2-VL-7B是Qwen-VL模型的最新迭代,代表了近一年的創新成果。該模型在視覺理解基準測試中取得了最先進的性能,包括MathVista、DocVQA、RealWorldQA、MTVQA等。它能夠理解超過20分鐘的視頻,為基於視頻的問題回答、對話、內容創作等提供高品質的支援。此外,Qwen2-VL也支援多語言,除了英語和中文,還包括大多數歐洲語言、日語、韓語、阿拉伯語、越南語等。模型架構更新包括Naive Dynamic Resolution和Multimodal Rotary Position Embedding (M-ROPE),增強了其多模態處理能力。

需求人群:

" Qwen2-VL-7B的目標受眾包括研究人員、開發者和企業用戶,特別是那些需要進行視覺語言理解和文字生成的領域。該模型可以應用於自動內容創作、視訊分析、多語言文字理解等多個場景,幫助使用者提高效率和準確性。

使用場景範例:

案例一:使用Qwen2-VL-7B進行視訊內容的自動摘要和問題回答。

案例二:整合Qwen2-VL-7B到行動應用程式中,實現基於影像的搜尋與推薦。

案例三:利用Qwen2-VL-7B進行多語言文件的視覺問答和內容分析。

產品特色:

- 支援各種解析度和比例的影像理解:Qwen2-VL在視覺理解基準測試中取得了最先進的性能。

- 理解超過20分鐘的視頻:Qwen2-VL能夠理解長視頻,支援高品質的視頻問題回答和對話。

- 整合到行動裝置和機器人等設備:Qwen2-VL具備複雜推理和決策能力,可整合到行動裝置和機器人中,實現基於視覺環境和文字指令的自動操作。

- 多語言支援:Qwen2-VL支援多種語言的文字理解,包括大多數歐洲語言、日語、韓語、阿拉伯語、越南語等。

- 任意影像解析度處理:Qwen2-VL可以處理任意影像分辨率,提供更接近人類視覺處理的體驗。

- 多模態旋轉位置嵌入(M-ROPE):Qwen2-VL透過分解位置嵌入來捕捉1D文字、2D視覺和3D視訊位置訊息,增強其多模態處理能力。

使用教學:

1. 安裝最新版本的Hugging Face transformers函式庫,使用指令`pip install -U transformers`。

2. 造訪Qwen2-VL-7B的Hugging Face頁面,以了解模型的詳細資訊和使用指南。

3. 根據具體需求,選擇合適的預訓練模型進行下載和部署。

4. 使用Hugging Face提供的工具和接口,將Qwen2-VL-7B整合到自己的專案中。

5. 根據模型的API文檔,編寫程式碼以實現圖像和文字的輸入處理。

6. 運行模型,取得輸出結果,並根據需要進行後處理。

7. 根據模型的輸出,進行進一步的分析或應用開發。