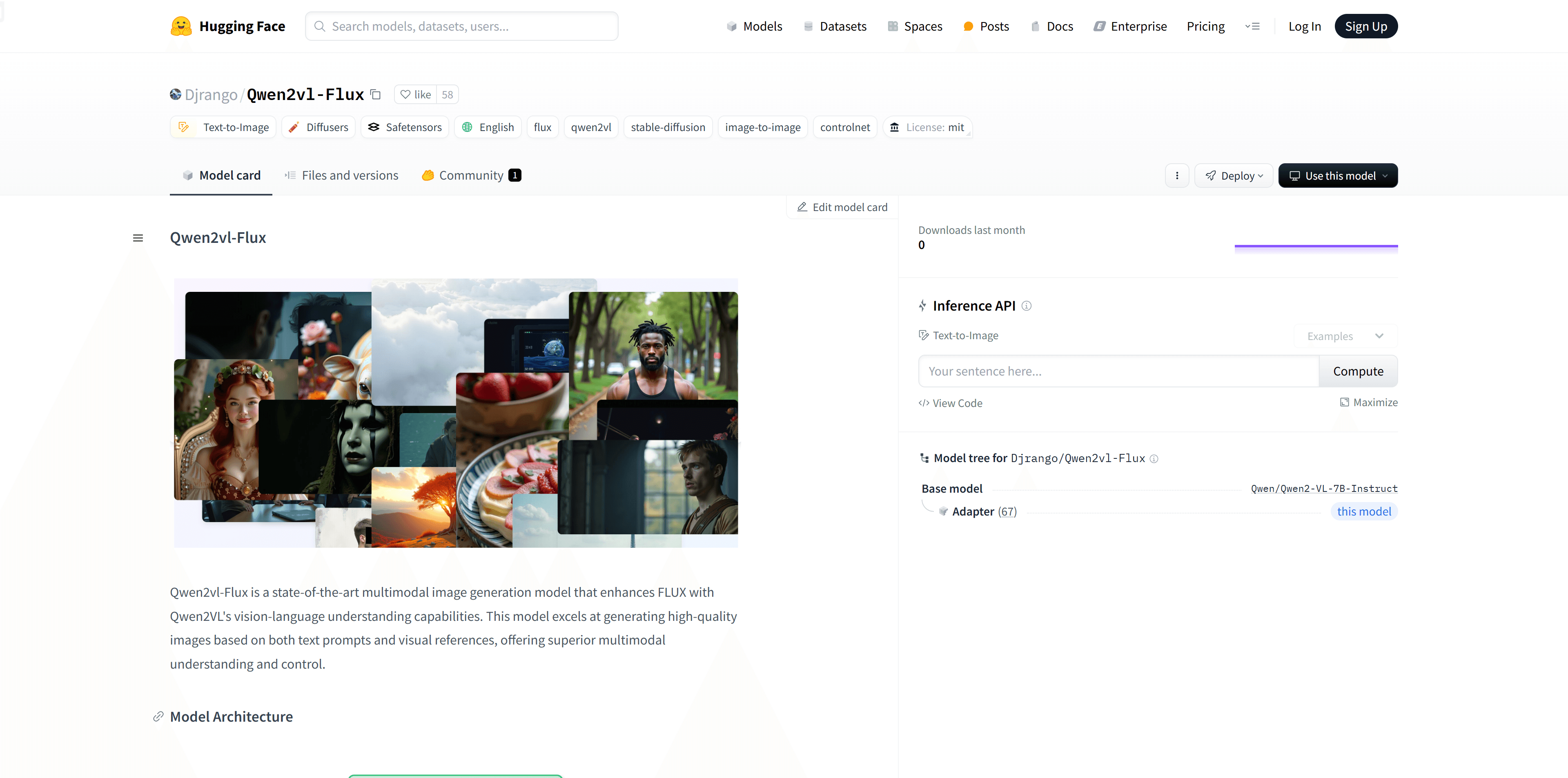

Qwen2vl-Flux是一個結合了Qwen2VL視覺語言理解能力的FLUX框架的先進多模態影像生成模型。該模型擅長基於文字提示和視覺參考生成高品質圖像,提供卓越的多模態理解和控制。產品背景資訊顯示, Qwen2vl-Flux整合了Qwen2VL的視覺語言能力,增強了FLUX的影像生成精確度和情境感知能力。其主要優點包括增強的視覺語言理解、多種生成模式、結構控制、靈活的注意力機制和高解析度輸出。

需求人群:

" 目標受眾為需要進行高品質圖像生成的專業人士,如設計師、藝術家和研究人員。Qwen2vl Qwen2vl-Flux適合他們因為它提供了基於文本和視覺參考的高控制度和高品質的圖像生成能力,有助於他們實現創意和研究目標。

使用場景範例:

創建在保持原始圖像本質的同時產生多樣化變體。

無縫混合多個影像,智慧風格遷移。

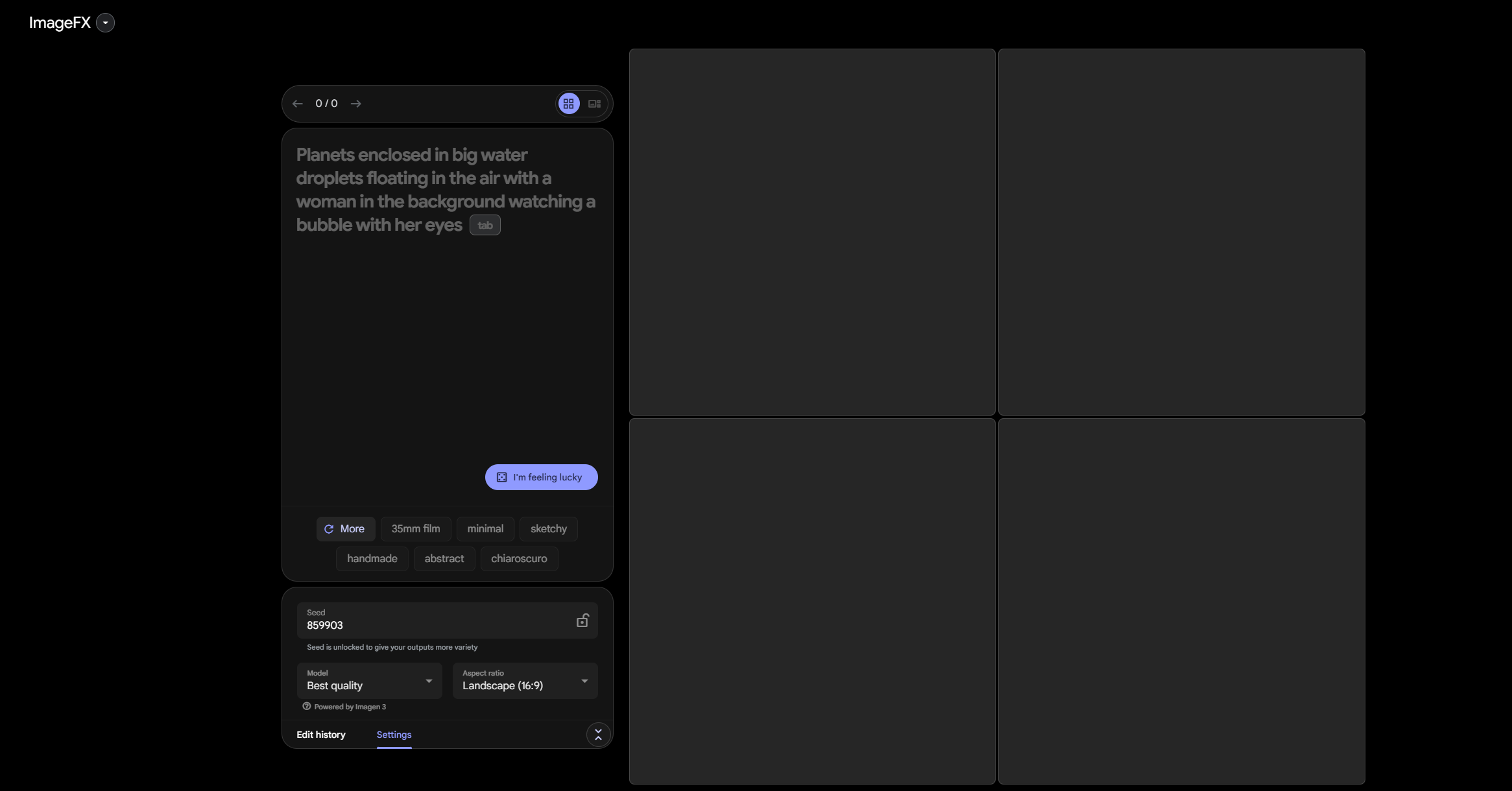

透過文字提示控制圖像生成。

應用細粒度風格控制的網格注意力。

產品特色:

增強視覺語言理解:利用Qwen2VL實現更優的多模態理解。

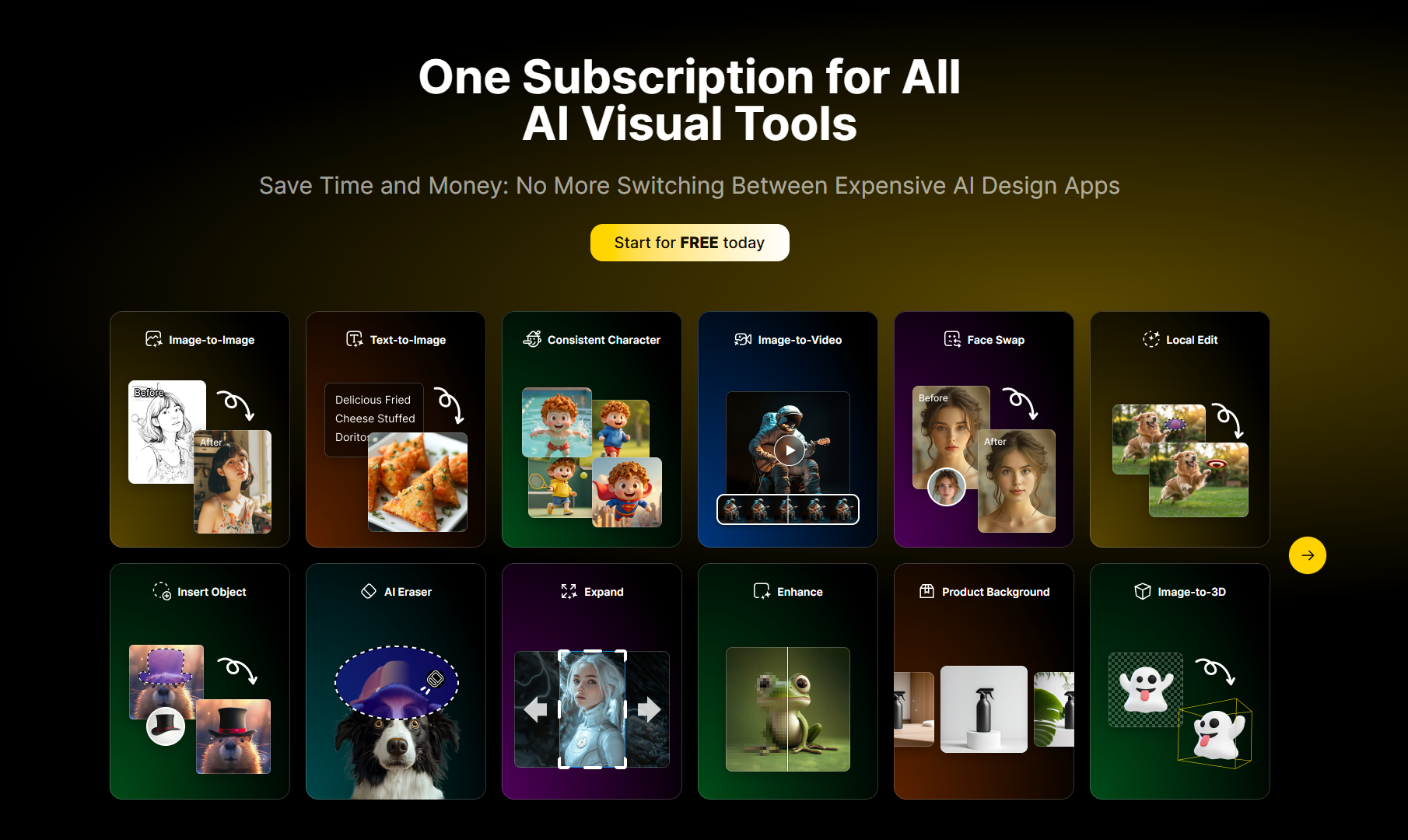

多種生成模式:支援變體、影像到影像、修復和控制網引導的生成。

結構控制:整合深度估計和線條檢測,提供精確的結構引導。

靈活的注意力機制:支持透過空間注意力控制的聚焦生成。

高解析度輸出:支援多種寬高比,最高可達1536x1024。

使用教學:

1. 複製GitHub倉庫並安裝依賴:使用git clone指令複製Qwen2vl-Flux的GitHub倉庫,並進入目錄安裝依賴。

2. 從Hugging Face下載模型檢查點:使用huggingface_hub的snapshot_download函數下載Qwen2vl-Flux模型。

3. 初始化模型:在Python程式碼中導入FluxModel,並在指定裝置上初始化模型。

4. 影像變體產生:使用模型的generate方法,輸入原始影像和文字提示,選擇'variation'模式產生影像變體。

5. 影像混合:輸入來源影像和參考影像,選擇'img2img'模式,並設定去雜訊強度,產生混合影像。

6. 文字引導混合:輸入影像和文字提示,選擇'variation'模式,並設定引導比例,產生文字引導的影像混合。

7. 網格風格遷移:輸入內容圖像和風格圖像,選擇'controlnet'模式,並啟用線條模式和深度模式,進行風格遷移。