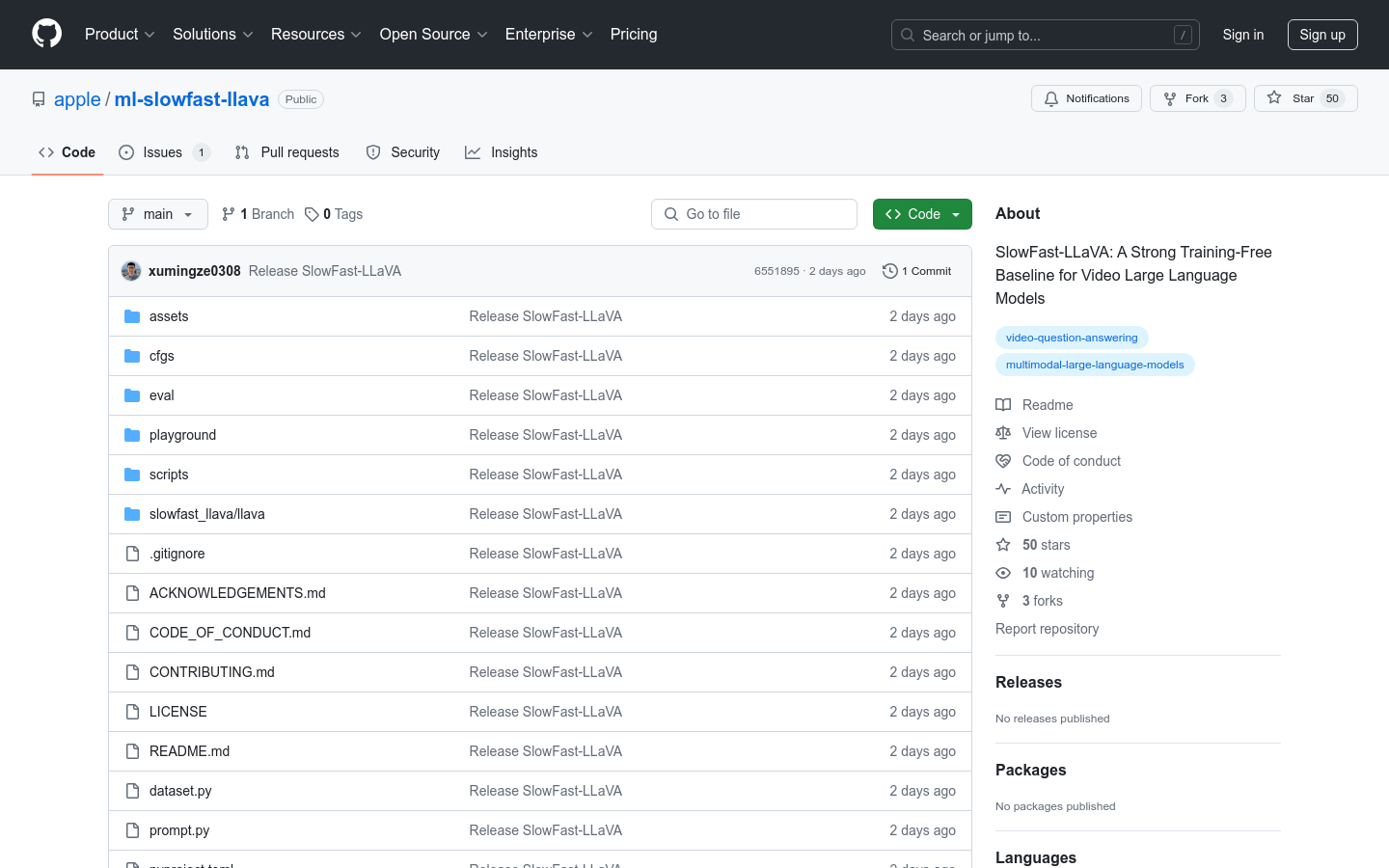

SlowFast-LLaVA

SlowFast-LLaVA是一種無需訓練的視訊理解模型,在各種基準測試中優於許多 SOTA 模型。

什麼是SlowFast-LLaVA ?

SlowFast-LLaVA是專為視訊理解和推理而設計的免訓練多模態大語言模型。它可以在各種視訊問答任務和基準測試上達到與領先的視訊大語言模型相當甚至更好的性能,而無需任何微調。

誰可以從SlowFast-LLaVA中受益?

該模型非常適合研究人員和開發人員,特別是那些專注於視訊理解和人工智慧的人。它使他們能夠快速部署和測試視訊問答系統,而無需耗時的模型訓練過程。

使用場景範例:

研究人員可以使用SlowFast-LLaVA開發自動視訊內容問答系統。

開發人員可以利用此模型來建立影片內容分析應用程式的原型。

教育機構可以採用它作為教學工具來指導學生先進的視訊理解技術。

主要特點:

視訊問答和推理無需培訓。

支援多個視訊問答任務和基準。

使用預先訓練的 LLaVA-NeXT 權重進行模型評估。

提供詳細的安裝和使用指南。

支援不同硬體環境的自訂配置。

包括用於演示和評估的大量範例程式碼和腳本。

逐步教學:

1. 安裝必要的軟體,包括CUDA、Python、PyTorch。

2. 將專案程式碼複製到本地並設定新的 conda 環境。

3. 依照指南安裝項目依賴並啟動環境。

4. 下載並準備所需的預訓練模型權重。

5. 準備資料集,包括影片和問答文件。

6. 根據需要調整設定檔中的參數。

7. 執行提供的腳本以進行模型推理和評估。

8. 分析輸出結果並根據需要細化模型或應用程式。