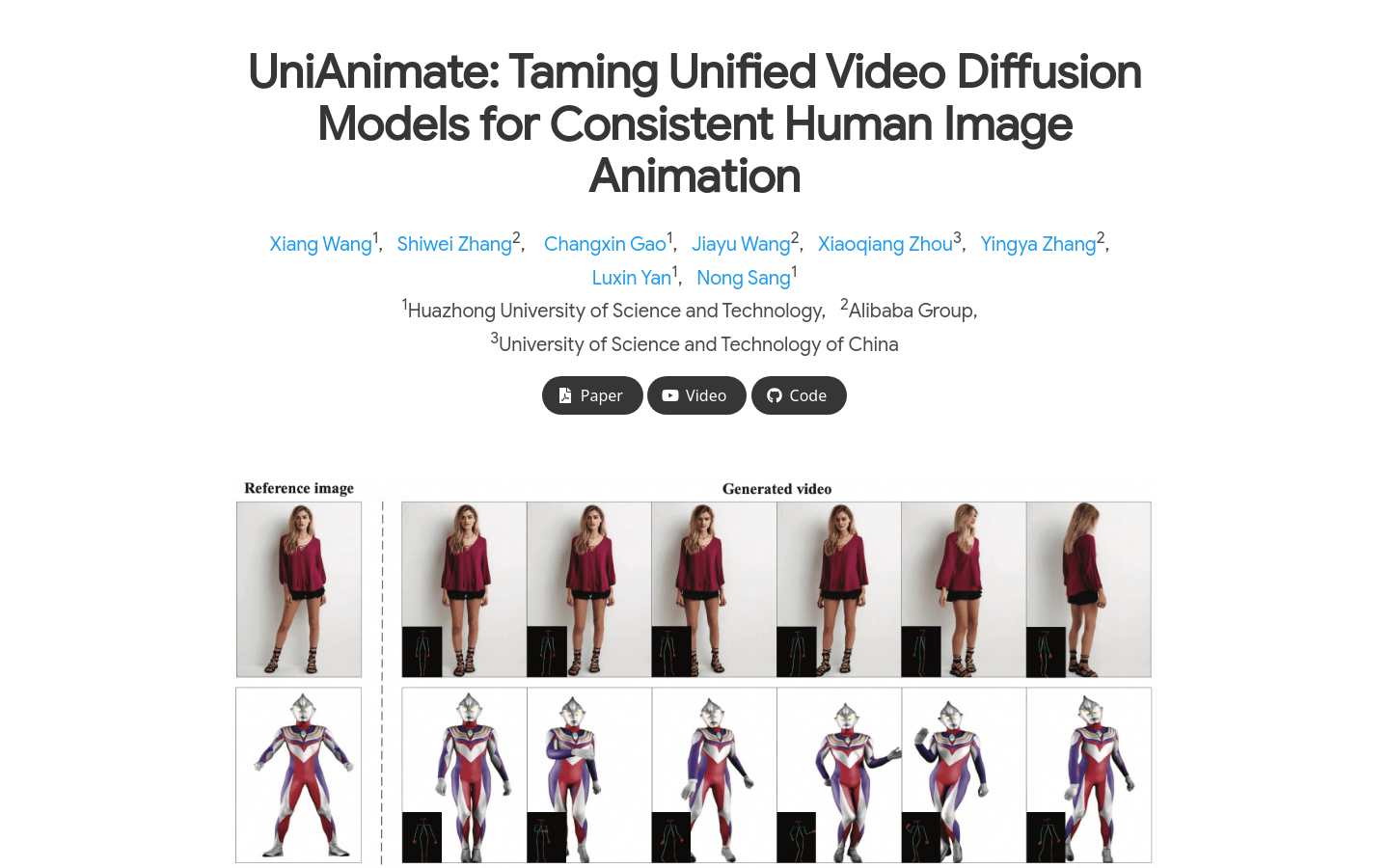

什么是 UniAnimate?

UniAnimate 是一个创新的视频生成框架,专门用于创建高质量的人物动画。它基于统一的视频扩散模型,能够将参考图像、目标姿势和噪声视频映射到同一个特征空间,从而简化优化过程并确保生成视频的时间连贯性。UniAnimate 不仅支持长序列视频生成,还能通过随机噪声或首帧条件输入,显著提升生成长期视频的能力。此外,它还引入了基于状态空间模型的时间建模架构,替代了传统计算密集型的时间 Transformer,进一步提高了效率。

谁需要 UniAnimate?

UniAnimate 主要面向计算机视觉和图形学领域的研究人员和开发者,尤其是那些专注于人物动画和视频生成的专业人士。它非常适合以下应用场景:

电影制作:生成高质量的人物动画,提升视觉效果。

游戏开发:创建连贯的人物动作序列,增强游戏体验。

虚拟现实:打造逼真的人物动态效果,提升沉浸感。

UniAnimate 的核心功能

1. 参考图像处理:使用 CLIP 编码器和 VAE 编码器提取参考图像的潜在特征。

2. 姿势指导整合:将参考姿势表示融入最终指导,帮助模型学习人体结构。

3. 目标姿势编码:通过姿势编码器对目标姿势序列进行编码,并与噪声输入结合。

4. 统一视频扩散模型:将结合后的输入数据输入模型,去除噪声并生成连贯视频。

5. 灵活的时间模块:支持时间 Transformer 或时间 Mamba,满足不同计算需求。

6. 视频输出:使用 VAE 解码器将生成的潜在视频转换为像素级输出。

如何使用 UniAnimate?

1. 准备一张参考图像和一系列目标姿势序列。

2. 使用 CLIP 编码器和 VAE 编码器提取参考图像的潜在特征。

3. 将参考姿势表示与潜在特征结合,形成参考指导。

4. 通过姿势编码器对目标姿势序列进行编码,并与噪声视频结合。

5. 将结合后的输入数据输入到统一视频扩散模型中进行噪声去除。

6. 根据需要选择时间模块(时间 Transformer 或时间 Mamba)。

7. 使用 VAE 解码器将处理后的潜在视频转换为最终的像素级视频输出。

为什么选择 UniAnimate?

UniAnimate 在定量和定性评估中均表现出色,超越了现有技术。它不仅能生成高质量的长序列视频,还能通过迭代使用首帧条件策略,生成高度一致的一分钟视频。无论是电影制作、游戏开发还是虚拟现实体验,UniAnimate 都能为用户提供高效、可靠的解决方案。

总结

UniAnimate 是一个功能强大且灵活的视频生成工具,专为人物动画设计。它通过创新的技术架构和高效的处理流程,帮助用户轻松创建高质量、连贯的长序列视频。如果你正在寻找一种能够提升人物动画效果的工具,UniAnimate 绝对值得一试!